Rna C5

Diunggah oleh

Bruno Turetto RodriguesJudul Asli

Hak Cipta

Format Tersedia

Bagikan dokumen Ini

Apakah menurut Anda dokumen ini bermanfaat?

Apakah konten ini tidak pantas?

Laporkan Dokumen IniHak Cipta:

Format Tersedia

Rna C5

Diunggah oleh

Bruno Turetto RodriguesHak Cipta:

Format Tersedia

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Captulo 5

Radial Basis Function

As RNAs do tipo Radial Basis Function (RBFs) so redes supervisionadas,

consideradas aproximadoras universais, assim como as RNAs Multilayer Perceptron

(MLPs) treinadas pelo algoritmo Backpropagation abordadas no captulo anterior. As

arquiteturas particulares das duas redes so, entretanto, muito diferentes. interessante

comentar algumas diferenas importantes entre as redes MLPs e as redes RBFs:

1. As unidades escondidas em redes MLPs dependem de somas ponderadas das

entradas, transformadas por funes de ativao monotnicas [5]. Uma funo de

ativao comumente aplicada s unidades escondidas de redes MLPs a funo

sigmoidal, que no-linear e continuamente diferencivel. Duas formas da funo

sigmoidal utilizadas so: a Funo Logstica e a Funo Tangente Hiperblica.

Em contraste, em uma RNA RBF, a ativao de uma unidade escondida

determinada por uma funo no-linear da distncia entre o vetor de entrada e um

vetor de referncia. As unidades escondidas de uma RNA RBF possuem funes de

ativao que so funes localizadas e que apresentam base radial definida sobre

seu domnio [5].

2. Uma rede MLP forma uma representao distribuda no espao de valores de

ativao para as unidades escondidas, j que, para um dado vetor de entrada, muitas

unidades escondidas contribuiro para a determinao do valor de sada, razo pela

qual as redes MLP tendem a resultar em aproximaes globais [7][5]. Durante o

treinamento, as funes representadas pelas unidades escondidas devem ser tais

que, quando linearmente combinadas pela camada final de pesos, gerem as sadas

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

corretas para um intervalo grande de possveis valores de entrada. A "interferncia"

e o "acoplamento cruzado" entre as unidades escondidas levam a resultados durante

o processo de treinamento da rede que so altamente no-lineares, resultando em

problemas de mnimos locais ou em regies quase planas na funo de erro, fatores

estes que podem levar a uma convergncia muito lenta do procedimento de treino,

mesmo com a utilizao de estratgias avanadas de otimizao [5].

Em contraste, as RNAs RBF, com funes de base localizadas, formam uma

representao no espao de unidades escondidas que local com respeito ao espao

de entrada porque, para um dado vetor de entrada, tipicamente apenas algumas

unidades escondidas apresentaro ativaes significantes. Por esta razo, as redes

RBF tendem a produzir aproximaes locais [7][5].

3. Uma rede MLP freqentemente tem muitas camadas de pesos e um complexo

padro de conectividade, de tal forma que nem todos os possveis pesos em uma

dada camada podem estar presentes. Ainda, uma variedade de diferentes funes de

ativao podem se utilizadas na mesma rede [5].

Uma rede RBF, no entanto, geralmente tem uma arquitetura simples, consistindo de

duas camadas de pesos, em que a primeira camada contm os parmetros das

funes de base radial e a segunda camada forma combinaes lineares das

ativaes das funes de base radial para gerar a sada [5].

4. Todos os parmetros em uma rede MLP so usualmente determinados ao mesmo

tempo, como parte de uma nica estratgia global de treinamento, envolvendo

treinamento supervisionado. Este tipo de treinamento apresenta um relativamente

alto custo computacional, decorrente da necessidade de retro-propagao do erro, o

que faz com que as redes MLPs apresentem uma caracterstica de aprendizado

lenta. No entanto, a performance de generalizao de uma rede MLP , em geral,

robusta [5].

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

J uma rede RBF tipicamente treinada em dois estgios, com as funes de base

radial

sendo determinadas primeiramente por meio de tcnicas no-

supervisionadas, usando para tal apenas os dados de entrada e a segunda camada

(de

pesos)

sendo

subseqentemente

determinada

por

mtodos

lineares

supervisionados, de rpida convergncia [5].

A diferente estratgia de treinamento e a conseqente diferena de velocidade de

treinamento entre as duas redes faz com que as redes MLP se mostrem menos

adequadas do que as redes RBF, quando estivermos interessados em operaes

dinmicas, que envolvam aprendizado continuado (como, por exemplo, em

predio de sries temporais e aplicaes on-line) [6][7].

5. No contexto de aproximao de funes, sob idnticas condies do ambiente no

qual esto inseridas, de uma forma geral pode-se afirmar que [5][6][7]:

erro final atingido por uma rede RBF menor do que o erro final atingido por

uma rede MLP;

a convergncia de uma rede RBF pode chegar a ser uma ordem de grandeza

mais rpida do que a convergncia de uma rede MLP;

a capacidade de generalizao de uma RNA MLP , em geral, superior

capacidade de generalizao de uma RNA RBF.

O projeto de uma rede neural RBF pode ser visto como um problema de ajuste de

curvas (ou, dito de outra forma, um problema de aproximao de funes) em um espao

de alta dimensionalidade. De acordo com este ponto de vista, o aprendizado de uma RBF

equivalente a encontrar uma superfcie em um espao multi-dimensional que melhor se

ajuste ao conjunto de dados de treinamento, sendo o critrio para o "melhor ajuste" medido

em algum sentido estatstico.

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

As redes neurais artificiais do tipo Radial Basis Function so ferramentas

extremamente flexveis em um ambiente dinmico. Elas tm a capacidade de aprender

rapidamente padres complexos e tendncias presentes nos dados e de se adaptar

rapidamente s mudanas. Estas caractersticas as tornam especialmente adequadas para

predio de sries temporais, especialmente aquelas sries regidas por processos nolineares e/ou no-estacionrios.

A primeira seo deste captulo discorre sobre as redes neurais RBF no contexto da

aproximao de funes, enquanto que a segunda seo descreve as redes RBF sob o

enfoque da predio no-linear de sries temporais.

5.1 RNAs Radial Basis Function no Contexto de

Aproximao de Funes

Conforme nos referimos na introduo deste captulo, as redes neurais artificiais do

tipo Radial Basis Function (RBF) compem uma classe de redes neurais artificiais

particularmente adequadas aproximao de funes.

Uma RNA RBF possui em sua arquitetura uma camada escondida definida por um

conjunto de funes de base radial, das quais a rede deriva seu nome.

O aprendizado de uma rede RBF equivalente a ajustar uma superfcie no-linear

ao conjunto de dados, em um espao muti-dimensional, de acordo com algum critrio

estatstico. O processo de generalizao equivale a usar esta superfcie multi-dimensional

para interpolar outros pontos que no pertenam ao conjunto de treino, mas estejam em sua

vizinhana.

Os neurnios da camada escondida de uma rede neural RBF so um conjunto de

funes que constitui uma base arbitrria no espao por eles formado, em cujo espao o

conjunto de entrada pode ser expandido. Os dados representados atravs de redes neurais

RBF so, portanto, expandidos com referncia a um conjunto finito de funes de ativao

neurais, chamadas funes de base radial [7][6]. Cada uma destas funes centrada em

4

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

uma particular coordenada do espao multi-dimensional dos pontos que compem o espao

de dados de entrada [6][5]. Cada uma destas coordenadas particulares caracteriza-se por

definir o centro de uma entre vrias possveis regio de maior aglomerao de pontos,

ou cluster [5], do espao de dados de entrada.

As redes neurais RBF foram originalmente desenvolvidas para interpolao de

dados em espaos multi-dimensionais. Segundo B. Mulgrew [1], o problema da

interpolao de dados pode ser assim formulado: dado um conjunto de vetores {u i } e um

conjunto de escalares {yi } , busca-se uma funo F ()

. , tal que,

yi = F (u i ) , i

(5.1)

Desde que definida analiticamente, a funo F ()

. pode ser usada para mapear

vetores u que no pertenam ao conjunto original, no conjunto de pontos y associados. Uma

possvel soluo para o mapeamento analtico escolher F (u ) , tal que:

F (u ) = wi u u i

i

onde u u i

) uma funo escalar radialmente simtrica,

(5.2)

tendo u i como centro. Os

vetores u i so, por esta razo, referidos como centros no contexto de redes neurais RBF. O

operador usualmente a norma Euclidiana ou Norma L2 e mede o mdulo do vetor

argumento, isto , a distncia Euclidiana da ponta do vetor sua origem [3][7]. A norma

Euclidiana de u M expressa por u =

M 1

(u m )2

T

= u .u .

m=0

Em 1986 Micchelli indicou a existncia de um conjunto de funes (tanto limitadas

quanto ilimitadas) que so adequadas para interpolao por resultarem em um conjunto de

equaes lineares para as incgnitas wi para as quais existe uma nica soluo [1][6]. A

Tabela 5.1 apresenta exemplos destas funes, mais comumente utilizadas como funes de

base radial.

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

O parmetro controla o raio de influncia de cada funo. Este fator

particularmente evidente no caso da funo multi-quadrtica inversa e da funo Gaussiana,

em que ambas as funes so, alm de localizadas, monotonicamente decrescentes

( ( ) 0 medida que ). O parmetro determina o quo rapidamente o valor

da funo de base radial cai a zero medida que u se afasta do centro u i .

log

2

Lmina spline fina

( ) =

Multi-Quadrtica

( ) = 2 + 2

Multi-quadrtica inversa

( ) =

2 + 2

2

( ) = exp 2

2

Gaussiana

Tabela 5.1: Algumas funes de base radial comumente utilizadas.

A funo de base radial do tipo Gaussiana a mais comumente utilizada em

aplicaes prticas, e ser a funo adotada nas redes neurais RBF estudadas neste captulo.

Neste tipo de funo de base radial, o parmetro corresponde ao desvio-padro da

funo Gaussiana. Assim, define a distncia Euclidiana mdia (raio mdio) que mede o

espalhamento dos dados representados pela funo de base radial em torno de seu centro.

Os raios de cada uma das funes de base radial de uma mesma rede RBF podem

assumir diferentes valores, no entanto, para redes RBF reais, o mesmo raio utilizado para

cada neurnio no-linear j permite que a rede uniformemente aproxime qualquer funo

contnua, desde que haja nmero suficiente de funes de base radial. Na prtica, o valor do

raio das funes de base radial afeta as propriedades numricas dos algoritmos de

aprendizado, mas no afeta a capacidade geral de aproximao das redes RBF [1][5].

6

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Originalmente, nas primeiras tentativas de aproximao de funes com redes RBF

eram utilizadas tantas funes de base radial quantos fossem os padres do conjunto de

dados representativo da funo a ser aproximada, objetivando a exatido da aproximao.

No entanto, esta abordagem no s era computacionalmente custosa, como tambm gerava

o problema de overfitting quando o objetivo era no s a aproximao como tambm a

interpolao dos pontos que geravam uma determinada funo [1][5].

A soluo para estes problemas foi apresentada por Broomhead e Lowe (1988) que

sugeriram modificaes ao procedimento de interpolao exata (que utiliza tantas funes

de base radial quantos forem os padres presentes nos dados). Uma delas permitir que

nem todos os vetores de entrada (do conjunto de dados) tenham uma funo de base radial

associada. A outra modificao sugerida exclui a necessidade de que a escolha dos centros

das funes de base radial seja restrita ao conjunto original de vetores. Para tanto,

Broomhead e Lowe reinterpretaram a rede RBF como um estimador de mnimos quadrados

(Least Squares Estimator) [1][5][6].

Consideradas estas duas generalizaes, o sistema de equaes lineares cujas

incgnitas so os pesos wi ser sobre-determinado. A soluo de tal sistema de equaes

lineares obtida atravs do uso da operao de pseudo-inverso matricial de

Moore-Penrose para a matriz de interpolao (matriz ) [6][8] e, em conseqncia, ser

uma soluo de mnimo erro mdio quadrtico.

Para que possamos compreender o pargrafo anterior, considere que, na rede RBF

tratada por Broomhead e Lowe, a determinao do vetor de pesos sinpticos obtida a

partir de uma operao de inverso matricial aplicada a uma matriz de interpolao . A

matriz funo das funes de base radial (e, portanto, dos respectivos centros e

varincias escolhidos) e dos vetores de treino pertencentes ao conjunto de dados, aplicados

entrada da rede.

Analiticamente, a matriz de interpolao [N K ] formada pelos vetores

i ,

i = 1,2, ! , N , sendo N o nmero de vetores pertencentes ao conjunto de treino da RNA. Os

vetores i resultam da aplicao dos vetores u i M , i = 1,2, ! , N , entrada da rede

7

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

RBF. Os elementos do vetor i K so as sadas de cada centro Gaussiano em resposta

ao vetor u i , i = 1,2, ! , N , aplicado entrada da rede (sendo, portanto, funes dos vetores

de entrada u i e dos vetores centro das funes de base radial, vetores t k ,

k = 1,2, ! , K onde K o nmero de funes de base radial adotadas para a RNA RBF).

Desta forma, pode ser expressa como

T

1 T 1 (u 1 ; t 1 ) (u 1 ; t 2 )

1 (u 2 ; t 1 ) (u 2 ; t 2 )

= 2 =

" "

"

"

T 1 (u N ; t 1 ) (u N ; t 2 )

! (u 1 ; t K )

! (u 2 ; t K )

#

"

! (u N ; t K )

(5.3)

Broomhead e Lowe propuseram que nem todos os vetores de entrada tivessem uma

funo de base radial associada, ou seja, N (nmero de vetores pertencentes ao conjunto de

treino da RNA) > K (nmero de funes de base radial adotadas para a RNA RBF). Com

N>K

o sistema de equaes lineares cujas incgnitas so os pesos wi ser

sobre-determinado, ou seja, ter mais equaes do que incgnitas. Para a soluo de tal

sistema utiliza-se o mtodo dos mnimos quadrados, que possui soluo atravs da

pseudo-inverso da matriz de interpolao .

A abordagem de Broomhead e Lowe resultou em uma significativa reduo de

custo computacional e no aumento da capacidade de generalizao das redes RBF, o que

possibilitou a sua aplicao a uma vasta gama de problemas em processamento digital de

sinais (por exemplo), tais como predio de sries temporais, modelamento de sistemas,

rejeio de interferncia e equalizao/desconvoluo de canal.

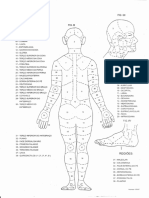

A Figura 5.1 apresenta a arquitetura da rede neural RBF que habitualmente usada

em tais aplicaes. A rede composta de uma camada de ns fonte (que conectam a rede a

seu ambiente externo), qual apresentado o vetor de entrada u (n ) M . Uma nica

camada intermediria de neurnios no-lineares, cada um deles computando uma funo

distncia entre o vetor de entrada e o centro da funo de base radial associada, constitui a

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

camada escondida. Na Figura 5.1 o mapeamento no-linear expresso por funes de

ativao Gaussianas, da forma

1

2

u (n ) t k (n ) ,

k (n ) = k u (n ), t k (n ), k2 (n ) = exp 2

k (n )

(5.4)

onde u (n ) M representa o vetor de entrada u no instante n, t k (n ) M representa o

vetor centro da ksima funo de base radial k = 0, 1,!, K 1 , K o nmero de funes

de base radial, e k2 (n ) a varincia associada a cada uma das funes no instante n.

Figura 5.1: Rede neural do tipo Radial Basis Function.

A camada de sada da rede neural formada por um nico neurnio linear. O

neurnio que compe a camada de sada definido como um combinador linear das

funes de base radial. A sada y da rede RBF , portanto, a soma das sadas de cada

Gaussiana, ponderadas pelos respectivos pesos sinpticos wk, de tal forma que a

combinao linear expressa por

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

y=

wk k ( u, t k , k2 )

(5.5)

K 1

k =0

Nesta equao, o termo k u , t k , k2 a ksima funo de base radial. Note que

k computa o quadrado da distncia Euclidiana D k 2 = u t k

entre um vetor de entrada

u e o centro t k da ksima funo de base radial. O sinal de sada produzido pelo ksimo

neurnio escondido , portanto, devido funo exp() e ao operador () , uma funo

2

no-linear da distncia Dk . O fator de escala wk representa o peso do caminho que conecta

o ksimo neurnio escondido ao n de sada da rede. Equao (5.5) pode, em alguns

casos, ser ainda acrescido um termo constante de polarizao ou bias [6].

A transformao no-linear acima referida definida pelo conjunto de funes de

base radial k e a transformao linear definida pelo conjunto de pesos wk,

k = 0, 1,!, K 1 .

O mapeamento entrada/sada de uma rede RBF Gaussiana muito semelhante

tcnica estatstica chamada Mistura de Modelos (mixture models), que so misturas de

distribuio de probabilidades [4][5]. Em particular, as misturas de distribuio de

probabilidades Gaussianas tm sido usadas como modelos em uma grande variedade de

aplicaes onde os dados de interesse provm de duas ou mais populaes misturadas entre

si, com parmetros estatsticos distintos. A resposta k do neurnio k da camada escondida

de uma rede RBF representa a densidade probabilstica condicional de u dado o centro t k ,

isto , k (u | t k ) . O coeficiente wk representa a probabilidade a priori de u no contexto da

densidade condicional k (u | t k ) . Assim, o conjunto das K densidades probabilsticas

condicionais modelam a funo de densidade de probabilidade representativa do

mecanismo estatstico subjacente que gerou os dados, sendo o modelamento definido

atravs de

K 1

w (u | t ). Neste sentido, a rede RBF muitas vezes referida como um

k =0

Estimador Bayesiano [4][5].

10

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

O procedimento para a implementao de uma rede neural RBF compreende a

determinao, atravs de um processo de aprendizagem, dos valores adequados aos

parmetros livres da RBF, que so as varincias k2 , os centros t k e os pesos sinpticos

wk . O aprendizado ou treinamento consiste em determinar estes parmetros de tal forma

que, dado um conjunto de estmulos u na entrada, as sadas y se aproximem o mais possvel

do conjunto de valores desejado.

Diferentes algoritmos podem ser utilizados para a adaptao dos parmetros livres

das redes RBF. Por exemplo, o algoritmo k-means [6][7] pode ser utilizado para a

inicializao e/ou atualizao dos centros das funes de base radial, o algoritmo de MoorePenrose para pseudo-inverso de matrizes [6] pode ser utilizado para a atualizao dos

pesos sinpticos, enquanto que o mtodo do Gradiente Estocstico [2][6] pode ser aplicado

na atualizao dos pesos da rede RBF, das varincias e dos centros das funes de base

radial. A Tabela 5.2 apresenta alguns dos possveis algoritmos de aprendizado empregados

para ajuste dos parmetros livres.

Possveis Algoritmos de Aprendizado para Ajuste dos Parmetros Livres

Centros das RBF

Pesos Sinpticos

Varincias dos centros

Constante: Por conhecimento

Gradiente Estocstico (LMS).

Constante: Por conhecimento

prvio e inferncia a partir do

Supervisionado: usa

prvio e inferncia a partir do

conjunto de vetores de treino.

e(n ) = d (n ) y (n )

conjunto de vetores de treino.

Clusterizao pelo algoritmo

Pseudo Inversa por decomposio

Gradiente Estocstico (LMS).

k-means. No-supervisionado.

em valores singulares:

Supervisionado: usa

w(n ) = 1 (n ). d (n )

e(n ) = d (n ) y (n )

Gradiente Estocstico (LMS).

()

()

2

2

k n = k n . max t n t n

a

b

a ,b

()

Supervisionado: usa

e(n ) = d (n ) y (n )

()

onde k (n ) fixo ou ajustado pelo

LMS.

Tabela 5.2: Possveis Algoritmos de Aprendizado [6].

11

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Diferentes modos de treinamento resultam da combinao dos algoritmos para

atualizao de centros, varincias e pesos sinpticos presentes na Tabela 5.2. As redes RBF

so, em geral, mais fceis de treinar do que os Multilayer Perceptrons (MLPs),

principalmente porque os processos de aprendizagem para os centros, as varincias e os

pesos sinpticos podem ser encadeados seqencialmente [1], possibilitando que o

aprendizado das redes RBF seja otimizado pela resultante diviso de tarefas.

Por exemplo, um algoritmo no-supervisionado pode ser utilizado para estimar os

centros, uma posterior estimativa da distncia do vetor de entrada com respeito a cada

centro pode ser usada para especificar e, finalmente, j tendo sido definidos os centros e

os raios , os pesos sinpticos podem ser calculados atravs do algoritmo LMS (Least

Mean Squares)[6]. Aps a estimativa inicial de parmetros da rede, um ajuste mais fino

pode ser dado a esta estimativa, utilizando tcnicas de gradiente aplicadas a todos os

parmetros, ao invs de apenas aos pesos sinpticos.

Uma abordagem clssica das redes neurais RBF sob a tica da interpolao de

funes tratada em [6]. Neste modo de treinamento, em que utilizado o algoritmo

Gradiente Estocstico, os centros das funes de base radial e todos os demais parmetros

livres so atualizados atravs de um processo de aprendizado supervisionado, baseado na

minimizao da funo de custo dada pelo valor esperado do erro quadrtico entre a sada

fornecida pela rede RBF e a sada desejada para o processo.

Nesta abordagem, os centros das funes de base radial so primeiramente

inicializados pelo algoritmo k-means. A cada iterao n, o algoritmo k-means determina as

distncias entre o vetor u (n ) pertencente ao conjunto de entrada e cada um dos centros

~

t k (n ) . Ao centro k que corresponder menor distncia Equao (5.6) aplicada a

atualizao mostrada na Equao (5.7). Na Equao (5.7), a razo de atualizao do

algoritmo k-means.

As iteraes prosseguem at que

t k (n ) t k (n + 1) , k , onde um nmero

muito pequeno.

12

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

~

k (u ) = arg min u (n ) t k (n ) ; k = 0,1,!, K 1

(5.6)

~

t k (n ) + [u (n ) t k (n )]; k = k (u )

t (n + 1) =

t k (n ) ;

outros casos

(5.7)

Aps a inicializao dos centros pelo algoritmo k-means, e definindo a varincia

inicial comum a todos os centros pela Equao (5.8), os pesos sinpticos so inicializados

2

(t i t j ) expressa o quadrado da maior distncia

com zero. Na Equao (5.8), d max

Euclidiana entre os centros , isto , max t i t j

}.

2

(t i t j ); com i, j = 0,1,!, K 1

2 = d max

(5.8)

Para cada vetor u (n ) do conjunto de treino apresentado entrada da rede, a sada

y (n ) da rede RBF determinada e avaliada a diferena entre este valor de sada e aquele

desejado d (n ), conforme

e(n ) = d (n ) y (n )

(5.9)

O erro assim obtido utilizado para a posterior atualizao at a convergncia dos

centros, pesos sinpticos e varincia.

As equaes de atualizao, derivadas do algoritmo Gradiente Estocstico [6], so

expressas em (5.10), (5.11) e (5.12). Na Seo 5.1.3 deste captulo apresentada a

derivao das equaes de atualizao para os pesos sinpticos, os centros e as varincias

dos centros das funes de base radial.

wk (n +1) = wk (n ) + w e(n ) k (n )

t k (n + 1) = t k (n ) + 2 t e(n )wk (n ) k (n )

13

u (n ) t k (n )

k2 (n )

(5.10)

(5.11)

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

(n + 1) = (n ) + e(n )wk (n ) k (n )

2

k

2

k

u (n ) t k (n )

(5.12)

( (n ))

2

k

Observe que, nas equaes (5.10), (5.11) e (5.12) os parmetros w , t e

so, respectivamente, as razes de aprendizado da adaptao dos pesos sinpticos, dos

centros das funes de base radial e das varincias dos centros.

A apresentao de N vetores de dados u (n ) entrada da RBF, n = 0,1, !, N 1 ,

constitui uma poca de treino. Ao final de cada poca, o conjunto de vetores de dados

embaralhado, para evitar que a rede aprenda o padro seqencial de apresentao dos

vetores de treino. Isto porque estamos interessados na capacidade de generalizao da rede

com relao ao conjunto de dados em si, e a mesma ordem de apresentao dos vetores a

cada poca de treino poderia prejudicar tal capacidade de generalizao.

O treinamento de uma RBF atravs das Equaes (5.10) a (5.12) continuado at a

sua convergncia, situao em que o valor obtido para o erro de aproximao menor que

um valor mximo permitido

. O erro de aproximao ser definido na Seo 5.1.1.

5.1.1 Critrio de Avaliao do Erro de Aproximao

Para avaliar a capacidade de aproximao das redes RBF definido o MSEA, ou

seja, o Erro Mdio Quadrtico de Aproximao dado por

MSEA =

1

N

N 1

(d (n ) y(n ))2

n =0

14

(5.13)

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

5.1.2 Sumrio da Heurstica de Treino de uma RNA Radial

Basis Function no Contexto de Aproximao de

Funes

A heurstica de treino de uma rede neural do tipo RBF (no contexto de aproximao

de funes) proposta por Haykin em [6] baseada no algoritmo Gradiente Estocstico. Os

pesos sinpticos wk , os centros das funes de base radiais t k e as varincias dos centros

k

so atualizados atravs de um processo de aprendizado supervisionado baseado na

minimizao de J = E (d (n ) y(n ))2 .

I - Inicializao:

1. Subtrair o vetor mdia do conjunto de N vetores de treino.

2. Normalizar a i-sima componente de cada vetor de treino pelo desvio

padro do conjunto de N valores formado pela i-sima componente de

todos os N vetores de treino.

3. Normalizar o conjunto de N sadas desejadas para o intervalo [-1,+1].

4. Inicializar os centros das funes de base radial:

t k (n = 0 ) k-means

t k (n) + [u(n) t k (n)]; k = k~(u)

t (n + 1) =

outros casos

t k (n);

~

k (u ) = arg min u (n ) t k (n ) ; k = 0,1, ! , K 1

k

t k (n) t k (n + 1) , k

5. Inicializar os pesos sinpticos:

wk (n = 0 ) 0 ; k = 0,1, ! , K 1

15

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

6. Inicializar as varincias dos centros:

2

k2 (n = 0) d max

t i t j , k ; com i, j = 0,1, ! , K 1, onde

2

2

d max

t i t j = max t i t j

II - Treinamento:

1.

Apresentar vetor u (n ) ao conjunto de treino entrada da RBF.

2.

Calcular sada da rede atravs de

K 1

K 1

k =0

k =0

y (n ) = wk (n ) k (n ) =

3.

wk (n)exp 2 (n) u(n ) t k (n)

Determinar o erro instantneo de treinamento na iterao n atravs de

e(n ) = d (n ) y (n )

4.

Atualizar os pesos sinpticos wk conforme

wk (n +1) = wk (n ) + w e(n ) k (n )

Atualizar os centros das funes de base radial t k atravs de

t k (n + 1) = t k (n) + 2 t e(n)wk (n) k (n )

u (n ) t k (n)

k2 (n)

Atualizar as varincias dos centros das funes de base radial k 2 de

acordo com

k2

(n + 1)

= k2

(n ) + e(n )wk (n ) k (n )

16

u (n ) t k (n )

2

k

(n ))

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

5. Incrementar n (n = n + 1) .

Se

tal que todos os N

vetores do conjunto de treino foram

apresentados entrada da RBF (constituindo uma poca), executar o

procedimento II.6, caso contrrio executar o procedimento II.1.

6. Embaralhar aleatoriamente a ordem dos vetores ao conjunto de treino.

7. Determinar e avaliar o Erro Mdio Quadrtico de Aproximao dado por

MSEA =

1

N

N 1

(d (n) y(n))2

n =0

Se MSEA < executar II.8, caso contrrio, executar II.1.

8. Armazenar os parmetros da rede ( w , t e 2 ).

k

k

k

Observao:

Havendo bias, a Equao para a sada da rede (passo II.2) torna-se:

K 1

y (n ) = wk (n ) k (n ) + wb B

k =0

onde wb a transmitncia da sinapse do bias e B o valor do bias.

Neste caso, a equao para atualizao da sinapse do bias ( wb ) dada por

wb (n +1) = wb (n ) + w e(n )B

17

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

5.1.3 Derivao das equaes de atualizao para w k , t k e

k2 a partir do Gradiente Estocstico

Nesta Seo sero derivadas as equaes de atualizao para os pesos sinpticos, os

centros e as varincias dos centros das funes de base radial, respectivamente expressas

em (5.10), (5.11) e (5.12) , a partir do algoritmo Gradiente Estocstico,

Observe que, em alguns passos do desenvolvimento das equaes ao longo desta

seo, tomar-se- a liberdade de no explicitar o indexador n para as variveis envolvidas

(desde que seja inequivocamente definido pelo contexto). Tal medida tomada por

simplificao, para que as equaes se tornem mais compactas.

5.1.3.1

Derivao de wk (n )

Sabemos (do Captulo 3) que a equao de atualizao para os pesos sinpticos a

partir do algoritmo Gradiente Estocstico pode ser expressa por

w p (n + 1) = w p (n ) w p J (n ) ;

onde o parmetro

p = 0,1, ! , K 1 ,

(5.14)

w a razo de aprendizado (ou passo de adaptao) dos pesos

sinpticos e a funo de custo J expressa por

J=

1 2 1

e = (d y )2 ,

2

2

(5.15)

em que foi considerada a expresso para o erro dada por (5.9).

Observa-se a partir da Equao (5.14) que, para que possamos determinar w p (n )

precisamos encontrar p J . Desta forma, de (5.15) podemos escrever

18

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

pJ =

1

J

(d y )2

=

w p 2 w p

(5.16)

em que

(d y )2 = 2(d y ) (d y ) .

w p

w p

(5.17)

Na Equao (5.5) encontramos a expresso para a sada y da rede RBF que,

substituda em (5.17) conduz a

(d y )2 = 2(d y )

w p

w p

(5.18)

K 1

d wi i

i =0

que pode ser expandida em

(d y )2 = 2(d y ) d w0 0 w1 1 $ w p p $ w K 1 K 1

w p

w p

Como a sada desejada

(5.19)

no depende dos pesos sinpticos, e a derivada

w p dos termos expandidos s existir para wi = w p , teremos

(d y )2 = 2(d y ) p

w p

(5.20)

Substituindo (5.20) em (5.16) encontraremos

pJ =

)]

1

J

(d y )2 = 1 2(d y ) p = (d y ) p

=

2

w p 2 w p

(5.21)

Desta forma, substituindo (5.21) em (5.14) obteremos a equao de atualizao para

os pesos sinpticos, que pode ser expressa por

19

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

w p (n + 1) = w p (n ) w (d y ) p = w p (n ) + w e(n ) p (n )

(5.22)

Observe que a Equao (5.22) igual Equao (5.10).

5.1.3.2

Derivao de t k (n )

Passemos agora derivao da equao de atualizao para os vetores centro das

funes de base radial, a partir do algoritmo Gradiente Estocstico. Sabemos, do Captulo

3, que

t p (n + 1) = t p (n ) t p J (n ) ;

p = 0,1, ! , K 1

(5.23)

onde o parmetro t a razo de aprendizado (ou passo de adaptao) dos vetores centro

das funes de base radial e a funo de custo J , novamente, expressa pela Equao

(5.15).

Observa-se, a partir da Equao (5.23) que, para que possamos determinar t p (n )

precisamos encontrar p J . Desta forma, de (5.15) podemos escrever

pJ =

1

J

(d y )2

=

t p 2 t p

(5.24)

onde

(d y )2 = 2(d y )

t p

t p

K 1

wi i

i =0

(5.25)

Na Equao (5.4) encontramos a expresso para as funes de base radial i . A

partir de (5.4) podemos escrever

20

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

(d y )2 = 2(d y )

t p

t p

K 1

1

d wi exp 2 u t i

i

i =0

(5.26)

Expandindo o somatrio presente em (5.26), encontraremos

(d y )2 =

t p

d w0 e

= 2(d y )

t p

u t 0

02

w1e

u t1

(5.27)

u t p

12

2p

$ w p e

$ w K 1 e

u t K 1

2

K

1

Como a sada desejada d no depende dos centros das funes de base radial e a

derivada t p dos termos expandidos s existir para t i = t p , teremos

u t

2

(d y ) = 2(d y ) w p exp

2

t p

t p

p

u t p

= 2(d y )( 2 )w p

2p

u t

p

exp

2p

u t

p

exp

2

(5.28)

Substituindo (5.28) em (5.24),

u t p

1

p J = 2(d y )( 2 )w p

2p

2

u t p

= 2w p (d y )

2p

u t

p

exp

2p

21

(5.29)

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Levando o resultado de p J obtido em (5.29) Equao (5.23), teremos

u (n ) t p (n )

(n )

t p (n + 1) = t p (n ) + 2 t w p (n ) e(n )

2p (n ) p

(5.30)

Observe que a Equao (5.30) igual Equao (5.11).

5.1.3.3

2

Derivao de k (n )

Tendo derivado as equaes de atualizao para os pesos sinpticos e para os

vetores centro das funes de base radial a partir do algoritmo Gradiente Estocstico, restanos derivar a equao de atualizao para as varincias dos centros das funes de base

radial.

Assim, fazendo p = 2p , partiremos de

p (n + 1) = p (n ) p J (n ) ;

p = 0,1, ! , K 1

(5.31)

onde o parmetro razo de aprendizado (ou passo de adaptao) das varincias dos

centros das funes de base radial. A funo de custo J expressa pela Equao (5.15).

A partir de (5.31) observa-se que, para a determinao de p (n ) , precisamos

encontrar p J . Desta forma, a partir de (5.15) podemos escrever

pJ =

1

J

(d y )2

=

p 2 p

onde

22

(5.32)

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

(d y )2 = 2(d y )

p

p

(5.33)

K 1

wi i

i =0

Na Equao (5.4) encontramos a expresso para as funes de base radial i . A

partir de (5.4) podemos escrever

(d y )2 = 2(d y )

p

p

K 1

1

d

wi exp

u ti

i =0

i

(5.34)

Expandindo o somatrio presente em (5.34), encontraremos

(d y )2 =

p

d w0 e

= 2(d y )

p

u t 0

w1e

u t1

(5.35)

$ w p e

u t p

$ w K 1e

u t K 1

K 1

Como a sada desejada d no depende das varincias das funes de base radial e a

derivada p dos termos expandidos s existir para i = p , teremos

u t

2

(d y ) = 2(d y )

w p exp

p

p

p

Como

(5.36)

c c

c

exp = 2 exp , (5.36) pode ser escrita sob a forma

x

x x

x

u t 2

2

(d y ) = 2(d y ) w p

2

p

p

( )

23

u t

exp

p

(5.37)

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Levando o resultado de (5.37) Equao (5.32), teremos

1

J

pJ =

= 2(d y ) w p

p 2

u t 2

2

p

u t 2

p

= (d y ) w p

2

p

( )

( )

u t

exp

p

u t

exp

p

(5.38)

Substituindo o resultado obtido para p J em (5.38) na Equao (5.31), teremos

u t 2

p

p (n + 1) = p (n ) (d y ) w p

2

p

( )

u t

exp

p

(5.39)

Considerando que e(n ) = d (n ) y (n ) e p = 2p , teremos

u (n ) t (n ) 2

p

(n + 1) = (n ) + e(n ) w p (n ) p (n )

2

2p

2

p

2

p

( )

(5.40)

Observe que a Equao (5.40) igual Equao (5.12).

5.1.4 RNAs Radial Basis Function no Contexto de

Aproximao de Funes: Exemplo

Este item destina-se apresentao dos resultados experimentais obtidos no

procedimento de treinamento em que os centros so inicializados pelo algoritmo k-means e

a atualizao at a convergncia dos centros, varincias e pesos sinpticos efetuada

24

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

atravs do Gradiente Estocstico. Este o algoritmo clssico apresentado em [6] e cuja

heurstica descrita na Seo 5.1.2.

Considere a situao hipottica em que se deseja estabelecer a relao analtica entre

os oito primeiro algarismos representados em base binria e os valores que definem o

quadrado de um dcimo de sua representao em base decimal, conforme mostrado na

Tabela 5.3.

u 3

u0

u1

u2

F (u )

0.0

0.01

0.04

0.09

0.16

0.25

0.36

0.49

Tabela 5.3: Mapeamento F : 3 que se deseja aproximar.

Uma possvel soluo seria tentar expressar F (u ) ,

u = [u 0 u1 u 2 ] , atravs do

T

mapeamento linear F (u ) = w u = w0 u 0 + w1u1 + w2 u 2 , sendo w = [w0 w1 w2 ] o vetor que

T

define F (u ) obtido da soluo do sistema de equaes

0w0

0w0

0w0

0w0

1w0

1w0

1w0

1w0

+ 0w1

+ 0w1

+ 1w1

+ 1w1

+ 0w1

+ 0w1

+ 1w1

+ 1w1

+ 0w2

+ 1w2

+ 0w2

+ 1w2

+ 0w2

+ 1w2

+ 0w2

+ 1w2

25

=

=

=

=

=

=

=

=

0.0

0.01

0.04

0.09

0.16

0.25

0.36

0.49

(5.41)

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

o qual evidentemente sobre-determinado sem soluo pois no existe

w = [w0 w1 w2 ] que atenda simultaneamente todas as Equaes (5.41) .

T

No entanto, o mapeamento F : 3 pode ser feito um mapeamento no-linear

quando expresso pela rede neural RBF da Figura 5.1. Especificamente, o conjunto de

N = 8 vetores u (n ) 3 da Tabela 5.3, n = 0,1, !, N 1 , considerado como o conjunto

de treino da rede RBF, com sada desejada d (n ) dado pelo respectivo valor na coluna F (u )

da tabela, isto , d (n ) = F (u (n )) . Como u (n ) 3 , faz-se M = 3 . Adotou-se K = 3 funes

de base radial para formar a superfcie de aproximao. Os centros das funes de base

radial so inicializados pelo algoritmo k-means, atravs da Equao (5.7) com = 0.1 , e as

varincias so inicializadas pelo valor dado pela Equao (5.8). A atualizao dos pesos

sinpticos, centros e varincias, atravs das Equaes (5.10) a (5.12), utiliza as razes de

aprendizado w = 0.1 , t = 0.1 e = 0.1 .

Para o treinamento da rede RBF, o conjunto de treino normalizado de forma que

os seus valores extremos situem-se no intervalo [ 1, 1] . Esta uma precauo usual, que

visa evitar overflow das variveis de ponto flutuante ao longo da operao do algoritmo

Gradiente Estocstico. Cada componente do conjunto de vetores u (n ) 3 normalizado

atravs da transformao u : , u (x ) = 2 x 1 , e cada um dos valores do conjunto de

N sadas desejadas d (n ), n = 0,1, !, N 1 , normalizado atravs da transformao

d : , d (x ) = 4.08163x 1 .

A apresentao dos N = 8 vetores do conjunto de treino definido pela Tabela 5.3

constitui uma poca. A Figura 5.2 mostra a evoluo do NMSEA1, medida que as pocas

de treinamento se sucedem. Aps 2000 pocas de treino, a rede RBF apresenta a relao

analtica dada pela Equao (5.42) como aproximao para o mapeamento da Tabela 5.3.

Note que a Equao (5.42) inclui o efeito das normalizaes u e d .

NMSEA (Erro Mdio Quadrtico

Normalizado de Aproximao), dado por

1

NMSEA =

N

26

(d (n ) y(n ))2

(d (n ))2

n=0

N 1

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Figura 5.2: Evoluo do NMSEA medida que as pocas de treinamento se sucedem,

com conjunto de treino definido pela Tabela 5.3.

2

0.069259

(2u 1) 0.962758

0.015931

1.948417 exp

+

2.774243

1.265731

(2u 1) 0.180856

0.316373

+

+1

2.111299 exp

2.372715

1.234718

(2u 1) 1.019335

0.118491

1.045209 exp

1.934487

F (u ) =

4.08163

27

(5.42)

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Verificando a consistncia de (5.42) para representar o mapeamento da Tabela

5.3,

temos

F [0 0 0] = 7.739 10 6 ,

que

F [0 0 1] = 0.01 ,

T

F [0 11] = 0.09 , F [1 0 0] = 0.16 , F [1 0 1] = 0.25 , F [11 0] = 0.36 ,

T

(

)

F ( [111] ) = 0.49 .

F [0 1 0] = 0.04 ,

T

Portanto, a Equao (5.42) representa a Tabela 5.3 com boa aproximao.

5.2 Redes Neurais Artificiais RBF no Contexto de

Filtragem Preditiva No-Linear

Se conhecemos o comportamento passado de um sinal at um determinado ponto no

tempo possvel fazer alguma inferncia sobre seus valores futuros. Tal processo de

inferncia conhecido como predio.

A predio de sries temporais um estudo de extrema relevncia, j que exemplos

de sries temporais so abundantemente encontrados na natureza (em campos tais como

geofsica, astrofsica e meteorologia), nas cincias sociais (em campos como a demografia),

nas cincias mdicas (em estudos de processos fisiolgicos involuntrios), nas cincias

econmicas (no acompanhamento das taxas de cmbio de moedas e mercado de aes) e

nas diversas engenharias (em tratamento e transmisso de sinais, sistemas dinmicos, etc.),

entre muitos outros.

Nesta seo estudaremos as RNAs RBF no contexto de Filtragem Preditiva NoLinear. Como introduo ao estudo da predio no-linear de sries temporais atravs de

redes neurais RBF, primeiramente apresentaremos uma abordagem de predio de sries

temporais atravs de predio linear.

Em captulos anteriores vimos que as redes neurais artificiais tm a capacidade de

aprender padres subjacentes presentes nos conjuntos de dados, apresentando melhor

desempenho que os mtodos estatsticos tradicionais quando o processo regente dos dados

desconhecido, no-linear e/ou no-estacionrio como o so a maior parte dos processos

28

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

encontrados no mundo real. Por esta razo representam uma grande contribuio ao estudo

das sries temporais resultantes de tais processos [7].

Estudamos tambm que as redes neurais artificiais supervisionadas constituem uma

classe particular de RNAs que tm a capacidade de mimetizar processos estocsticos

associados a conjuntos de dados, atravs do aprendizado. Assim como na forma

convencional de um filtro linear adaptativo, as RNAs supervisionadas tm a capacidade de,

atravs da informao de uma resposta desejada tentar aproximar um sinal alvo durante o

processo de aprendizado. Esta aproximao obtida atravs do ajuste, de forma

sistemtica, de um conjunto de parmetros livres, caracterstico de cada rede neural. Na

verdade, o conjunto de parmetros livres prov um mecanismo para armazenar o contedo

de informao subjacente presente nos dados que so apresentados rede na fase de

treinamento [7][5].

Os dois principais tipos de redes neurais artificiais supervisionadas so as redes

MLP (Multilayer Perceptrons) treinadas pelo algoritmo back-propagation e as redes RBF

(Radial Basis Function). Como sabemos, ambas as redes so aproximadoras universais. No

entanto, quando se trata de aprendizado continuado, como no caso da predio de sries

temporais, as redes MLP se mostram menos adequadas porque o custo computacional de

treino de uma rede MLP muito superior ao de uma rede RBF, o que impossibilita a

operao de forma dinmica [6][7].

J as RNAs RBF possuem caractersticas especiais que as capacitam a aprender

rapidamente padres complexos e tendncias presentes nos dados e a se adaptar

rapidamente a mudanas. Estas caractersticas as tornam especialmente adequadas

predio de sries temporais, especialmente aquelas sries regidas por processos nolineares e/ou no-estacionrios, casos em que as tcnicas lineares de modelamento tm

sucesso apenas limitado em seu desempenho.

29

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

5.2.1 Predio Linear de Sries Temporais

A predio linear considera o problema de predio da amostra u (n + 1) ,

subseqente a um conjunto conhecido de amostras consecutivas prvias {u (n ), u (n 1), !}

pertencentes a uma srie temporal discreta, problema este conhecido como predio a um

passo [3].

Em predio linear, a estimativa da amostra predita, u (n + 1) , expressa como uma

combinao linear de M amostras prvias {u (n ), u (n 1), !, u (n M + 1)}. Os coeficientes

Wk , k = 0, 1,!, M 1 que ponderam tal combinao linear definem um filtro FIR [9]

transversal.

A Figura 5.3 detalha um preditor FIR de ordem M, o qual mostrado no instante n

naquela figura [6]. Portanto, como o instante definido, visando tornar compactas as

equaes no desenvolvimento que segue, no ser explicitado o indexador n para as

variveis envolvidas, a menos que n no seja inequivocamente definido pelo contexto.

Um preditor linear de ordem M utiliza M amostras prvias conhecidas da srie

temporal para estimar u (n + 1) , no entanto, necessita do conhecimento de todas as amostras

que compem a srie para emular a matriz de correlao associada.

A funo de custo J mede o erro mdio quadrtico entre a estimativa da predio

y (n ) = u (n + 1) e o valor efetivamente obtido para a amostra em questo, u (n + 1) . O vetor

W que define o filtro FIR tem seus coeficientes determinados de forma a minimizar a

funo de custo J.

Conforme pode ser observado na Figura 5.3, a amostra predita u (n + 1) dada por

M 1

T

u (n + 1) = y (n ) = Wk u (n k ) = W u

k =0

30

(5.43)

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Figura 5.3: Filtro Linear Transversal utilizado como preditor de u (n + 1) com ordem de

predio M = 8 . E{}

o operador que resulta no valor esperado do argumento [10].

Da Figura 5.3, o erro de predio e(n) pode ser expresso por

e(n ) = d (n ) y (n )

(5.44)

O operador gradiente aplicado com o intuito de obter os valores para os pesos Wi

do filtro transversal que minimizem a funo de custo J, resolvendo-se a equao J = 0.

Assim, tomando a derivada parcial da funo de custo J com relao a cada peso Wi,

i J =

{ }

(d y ) = E 2e y ;

=

E e 2 = E 2e

= E 2e

Wi Wi

Wi

Wi

Wi

i = 0, 1, ! , M 1

31

(5.45)

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

E, considerando o gradiente a partir do instante n, teremos

y (n )

i J (n ) = E 2e(n )

= E 2e(n )

Wi

Wi

W u (n k ) = 2 E{e(n )u (n i )}

M 1

k =0

(5.46)

Como a funo de custo J uma funo quadrtica, J ser globalmente mnimo para

J = 0. Assim, a partir da Equao (5.46) podemos escrever que

i J (n ) = 2 E{e(n ) u (n i )}= 0

(5.47)

Substituindo as Equaes (5.43) e (5.44) na Equao (5.47), obteremos

M 1

E d (n ) Wk u (n k ) u (n i ) = 0

k =0

(5.48)

Distribuindo os produtos e rearranjando a Equao (5.48),

M 1

W E{u (n k ) u(n i )}= E{d (n ) u(n i )}

k =0

(5.49)

Observa-se no lado esquerdo da igualdade expressa na Equao (5.49), que

E{u (n k ) u (n i )}= Ruu (k i )

(5.50)

onde Ruu a funo de auto-correlao do processo aleatrio u (= processo estocstico)

para um atraso k i entre as amostras, com k , i = 0, 1,!, M 1 [10]. Da mesma forma,

observando o lado direito da igualdade expressa na Equao (5.49),

E{d (n ) u (n i )}= Rdu ( i )

(5.51)

onde Rdu a funo de correlao cruzada entre o processo aleatrio que descreve a sada

desejada d = u (n + 1) e o processo u.

Considerando as Equaes (5.50) e (5.51), a Equao (5.49) pode ser reescrita como

M 1

W R (k i ) = R ( i );

k =0

uu

i = 0 ,1,!, M-1

du

32

(5.52)

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Para escrever a Equao (5.52) sob a forma matricial, consideremos que seja

u (n ) = [u (n ) u (n 1) ! u (n M + 1)] , tal que

T

R = E u (n ) u (n )

T

(5.53)

isto

E{u (n )u (n )}

E{u (n )u (n 1)}

E{u (n 1)u (n )}

E{u (n 1)u (n 1)}

R=

"

"

E{u (n M + 1)u (n )} E{u (n M + 1)u (n 1)}

E{u (n )u (n M + 1)}

(5.54)

!

"

#

"

! E{u (n M + 1)u (n M + 1)}

!

ou

Ruu (1)

Ruu (0)

R (1)

Ruu (0)

uu

R=

"

"

Ruu (M 1) Ruu (M 2 )

! Ruu (M 1)

!

"

#

"

Ruu (0 )

!

(5.55)

Para melhor ilustrar as Equaes (5.53), (5.54) e (5.55), consideremos um exemplo.

Para o caso em que M=3, teremos u (n ) = [u (n ) u (n 1) u (n 2 )] e R ser dado por

T

R = E u (n ) u (n ) =

T

u (n )

= E u (n 1) [u (n ) u (n 1) u (n 2 )] =

u (n 2 )

Ruu (0) Ruu ( 1) Ruu ( 2 )

= Ruu (1) Ruu (0) Ruu ( 1)

Ruu (2) Ruu (1)

Ruu (0)

Mas, como Ruu (x ) = Ruu ( x ) , R poder, por fim, ser expresso como

33

(5.56)

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Ruu (0 ) Ruu (1) Ruu (2)

R = Ruu (1) Ruu (0 ) Ruu (1)

Ruu (2 ) Ruu (1) Ruu (0 )

(5.57)

Seja, agora, o vetor P definido por

P = E {d (n ) u (n )} =

(5.58)

= [E{d (n ) u (n )} E{d (n ) u (n 1)} ! E{d (n ) u (n M + 1)}] =

T

= [P(0) P( 1) ! P(1 M )]

e seja tambm o vetor de pesos dado por

W = [W0 W1 ! WM 1 ]

(5.59)

Assim, partindo das Equaes (5.52), (5.53), (5.55), (5.58) e (5.59), teremos

RW = P

(5.60)

A Equao (5.60) denominada Equao de Wiener-Hopf [6]. A soluo de (5.60)

para W define os coeficientes do filtro linear transversal mostrado na Figura 5.3. O filtro

prediz com o mnimo erro quadrtico mdio a amostra u (n + 1) de uma srie temporal que

apresenta correlao entre as M prvias amostras. Se a matriz de correlao R da srie

temporal no-singular para M definido, ento W pode ser obtido por

W = R 1 P

(5.61)

sendo P o vetor que define a correlao cruzada entre o vetor u (n ) de entrada e a sada

desejada d (n ) = u (n + 1) .

importante observar que, para uma dada srie temporal com N t amostras totais,

apresentando correlao entre M amostras consecutivas prvias ao instante a ser predito, a

preciso com que R e P representam as correlaes envolvidas ser tanto maior quanto

maior for N t com relao a M.

34

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Isto ocorre porque, na prtica, no se conhece o processo aleatrio subjacente que

determina a srie temporal em questo. Portanto, no so conhecidas as funes correlaes

que so realmente envolvidas no processo. Assim, o operador E{}

nas Equaes (5.53) e

(5.58) substitudo pela mdia dos vetores de M componentes envolvidos no cmputo de

R e P, mdia esta realizada sobre o intervalo de N t amostras totais conhecidas da srie

temporal.

Desta maneira, a predio linear s tem sentido quando o processo aleatrio

subjacente estacionrio [10], pois, em caso contrrio, R e P no so univocamente

definidas, mesmo para N t suficientemente grande. Ou seja, se a srie temporal resulta de

um processo aleatrio no-estacionrio, R e P variam ao longo da srie, invalidando a

Equao (5.61) para a obteno do vetor de pesos W. A soluo algumas vezes adotada

assumir que a srie temporal estacionria em intervalos e adaptar R e P para cada

intervalo. No entanto, o nmero de amostras em cada intervalo nem sempre suficiente

para expressar com fidelidade a operao E{}

.

Esta a razo do uso cada vez mais disseminado de tcnicas de predio no-linear,

as quais, embora apresentem custo computacional maior, contornam a necessidade do

conhecimento de um nmero grande de amostras passadas da srie a ser predita, suficientes

para que o operador E{}

seja aproximado com fidelidade pela mdia temporal.

Objetivando reduzir a complexidade computacional envolvida no cmputo da

Equao (5.61), como R resulta em uma matriz Teptliz [11], a sua inverso , em geral,

realizada pelo mtodo de Durbin-Levinson [6], muito embora a pseudo-inverso de MoorePenrose via Decomposio em Valores Singulares [6][8] seja freqentemente utilizada para

contornar os problemas resultantes de uma matriz R quase singular.

35

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

5.2.1.1 Critrio de Avaliao do Erro de Predio

Adotaremos como critrio para avaliao da qualidade de predio (tanto linear

quanto no-linear, que trataremos na prxima seo) o critrio sugerido por Gershenfeld e

Weigend em [12]. Este critrio de avaliao considerado referncia pela comunidade de

pesquisadores da rea de predio.

A qualidade da predio ser expressa em termos da razo entre as somas de erros

quadrticos mostrada em (5.62).

(observao predio )

(observao observao )

2

(5.62)

t 1

Em (5.62) o denominador expressa o erro mdio quadrtico (MSE) de predio

obtido para a chamada predio pela ltima amostra Tal mtodo de predio considera que

a melhor predio possvel para a prxima amostra consiste simplesmente em repetir o

valor efetivamente observado para a amostra atual. O valor obtido por tal critrio para o

MSE tomado como normalizador para o MSE resultante das diferenas entre os valores

efetivamente obtidos, aps a observao da amostra em questo, e os respectivos valores

obtidos pelo preditor que est sendo avaliado. Uma razo inferior a 1.0 corresponde a uma

predio melhor do que aquela obtida pela simples repetio do valor efetivamente

observado para a amostra anterior quela a ser predita limiar que qualifica um preditor

que pretenda ser til.

O erro obtido atravs do procedimento expresso em (5.62) chamado Erro Mdio

Quadrtico Normalizado (Normalized Mean Squared Error) e referido na literatura por

MSE.

36

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Expressando (5.62) em forma de equao, teremos

n

NMSE (n ) =

2

(o(i ) p(i ))

i =1

(o(i ) o(i 1))

i =1

(u (i + 1) u(i + 1))

(5.63)

i =0

(u (i + 1) u(i ))

i =0

onde o(i ) e p(i ) so respectivamente a observao (o valor efetivamente observado) e a

predio no instante i. Para uma dada srie temporal U com N t amostras totais o erro ao

final do processo de predio de U dado por NMSE( N t 1) , onde N t 1 o ndice do

ltimo elemento da srie.

5.2.1.2

Predio Linear de Sries Temporais: Exemplo

Nesta seo apresentaremos os resultados obtidos para a predio linear da srie

Chaotic_LASER, atravs da heurstica de predio descrita em 5.2.1.

Descrio da Srie Temporal Utilizada:

A srie Chaotic_LASER possui N t = 1000 amostras totais. Cada um dos 1000

pontos que a constituem corresponde intensidade de um Far-Infrared-LASER em estado

catico. A srie foi obtida por Udo Huebner do Phys.-Techn. Bundesanstalt, Braunschweig,

Germany. As medidas foram feitas a partir de um LASER NH3 no-pulsado [13].

A srie, cuja representao grfica mostrada na Figura 5.4 descrita por Weigend

e Gershenfeld em [12] e foi obtida de http://www.stern.nyu.edu/~aweigend/TimeSeries/SantaFe.html.

Observao: Em ambos os exemplos de predio de sries temporais que

apresentaremos neste estudo (caso linear e caso no-linear que ser apresentado na Seo

5.2.2) utilizaremos a srie Chaotic_LASER.

37

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Figura 5.4: Representao grfica da srie Chaotic_LASER. Ordenada: Intensidade

de um Far-Infrared-LASER em estado catico. Abscissa: ndice da medio.

A predio estimada u (n + 1) expressa como uma combinao linear de 11

amostras prvias, equivalendo a dizer que a ordem da predio linear adotada M = 11

(conforme heurstica de predio descrita em 5.2.1).

Os valores para os coeficientes que ponderam tal combinao linear foram obtidos

atravs de (5.61) e so W0 = -0.689614 , W1 = 0.545837 , W2 = - 0.206001 , W3 = 0.144179 ,

W4 = -0.109438 , W5 = 0.054155 , W6 = -0.402716 ,

W7 = -0.334968 , W8 = 0.221793 ,

W9 = -0.248085 e W10 = 0.0365866 , de tal forma que a Equao (5.43) resulta em:

u (n + 1) = 0.689614 u (n ) + 0.545837 u (n 1) 0.206001 u (n 2 ) + 0.144179 u (n 3) +

0.109438u (n 4 ) + 0.054155u (n 5) 0.402716u (n 6 ) 0.334968u (n 7 ) +

+ 0.221793u (n 8) 0.248085u (n 9) + 0.0365866u (n 10)

38

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Utilizando estes coeficientes no filtro FIR da Figura 5.3, o NMSE final resultante,

conforme Equao (5.63),

NMSE( N t 1) = 0.213 . A Figura 5.5 apresenta as

representaes grficas da srie Chaotic_LASER., observada e predita.

importante salientar que, apesar de a ordem de predio ser M = 11 , a predio

linear aqui efetuada necessita do conhecimento prvio de todos os N t = 1000 elementos da

srie temporal para montar a matriz de correlao R , na tentativa de aproximar o operador

E{}

pela mdia temporal obtida a partir dos elementos conhecidos.

Figura 5.5: Srie Chaotic_LASER Predio Linear M = 11 . NMSE( N t 1) = 0.213

39

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

5.2.2 Predio No-Linear de Sries Temporais atravs de

RNAs RBF

A rede neural artificial RBF utilizada para predio no-linear de sries temporais

dita dinmica, porque o aprendizado acontece de forma contnua com o desenrolar temporal

da srie [6]. A Figura 5.6 apresenta a arquitetura da rede RBF em questo.

Figura 5.6: RNA RBF utilizada para predio no-linear de

sries temporais.

Assim como a rede mostrada na Figura 5.1, esta rede RBF possui M ns de entrada

e K centros Gaussianos. O vetor t k M o ksimo vetor centro da rede RBF ou ksimo

vetor de estado do processo associado srie temporal S, wk o ksimo peso sinptico e

2 a varincia comum a todos os centros Gaussianos, com k = 0, 1,!, K 1 . No contexto

de predio de sries temporais, K o nmero de vetores de estado do processo e M a

ordem de predio [6][7].

40

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

A sada da rede neural RBF quando o nsimo vetor de entrada u (n ) M

apresentado sua entrada

y (n ) = wk (n ) k (n ) = (n ) w(n )

(5.64)

1

2

k (n ) = exp 2

u (n ) t k (n )

2 (n )

(5.65)

K 1

k =0

onde

a sada do ksimo centro Gaussiano com o vetor u (n ) aplicado entrada da rede RBF.

Para utilizar a rede RBF no contexto de predio de sries temporais torna-se

necessria a definio de algumas estruturas de dados.

Seja S uma srie temporal definida por S = {u (0), u (1),!, u (N t 1)}, onde N t o

nmero de amostras de S. A um instante n qualquer, o objetivo predizer a amostra

u (n + 1)

de

S,

sendo

conhecidas

u (n ), u (n 1), !, u (n M K + 1)

que

as

N =K +M

compem

amostras

janela

de

prvias

predio

p(n ) = {u (n M K + 1),!, u (n 1), u (n)} definida sobre S.

No instante n, seja o processo associado ao desenrolar temporal de S representado pelo

conjunto U de K + 1 vetores u (n ) M , = 0,1,!, K , definido sobre a janela p(n ) ,

de forma que dois vetores consecutivos de U estejam deslocados entre si da distncia

temporal entre duas amostras subseqentes de S, conforme mostra a Figura 5.7.

Seja, ainda, o vetor de entrada da rede RBF no instante n dado por

u (n ) = [u (n ) u (n 1) ! u (n M + 1)]

(5.66)

e seja, no instante n, o ksimo vetor de estado t k (n ) do processo associado ao desenrolar

temporal de S , dado por

41

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

t k (n ) = u (n k 1) , k = 0,1,!, K 1

(5.67)

A Figura 5.7 apresenta, a ttulo ilustrativo, a janela p (n) definida sobre S, a

construo dos vetores t k de estado do processo e os vetores de entrada u (n j ) ,

j = 0,1,!, K , para o caso em que K = 4 e M = 3 .

Figura 5.7: Elementos de interesse na srie temporal S no instante n e construo dos

vetores t k de estado do processo associado S e dos vetores de entrada u (n j ) ,

j = 0, 1, ! , K , k = 0, 1, !, K 1 , para o caso K = 4 e M = 3. Observe que p(n ) formada

por N = K + M = 7 amostras conhecidas, prvias a u (n + 1) .

Para que se defina a varincia 2 (n ) comum a todos os centros Gaussianos no

instante n, assume-se que 2 (n ) seja proporcional ao quadrado da mxima distncia

Euclidiana entre todos os vetores de estado do processo [6]:

42

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

2 (n ) = max t i (n ) t j (n )

}, i, j = 0,1,!, K 1

(5.68)

onde a constante de proporo chamada Fator de Varincia, a qual absorve a constante

2 da Equao (5.65).

Assim, a sada do ksimo centro Gaussiano, quando o vetor u (n ) aplicado

entrada da rede RBF pode ser definida como

2

u (n ) t k (n )

k (n ) = exp

2

max t i (n ) t j (n )

(5.69)

, i, j = 0,1,!, K 1

O conjunto k (n ) , k = 0, 1,!, K 1 , de sadas dos K centros Gaussianos, conjunto

que resulta da aplicao do vetor de entrada u (n ), pode ser colocado na forma vetorial

atravs de

(n ) = [ 0 (n ) 1 (n ) ! K 1 (n )]T

Por exemplo, (n 1) K

(5.70)

o vetor que resulta da aplicao do vetor

u (n 1) M entrada da rede RBF. Os elementos do vetor (n 1) K so as sadas de

cada centro Gaussiano ao vetor u (n 1) . O ksimo centro Gaussiano definido por seu

respectivo vetor t k M de estado do processo, k = 0, 1,!, K 1 .

Note que, a qualquer instante arbitrrio, a transformao no-linear definida pela

Equao (5.69) mapeia o vetor u (n ) M aplicado entrada da rede RBF, um

atraso arbitrrio qualquer, no vetor (n ) K . Portanto, a seqncia de vetores de

entrada

u (n 1), u (n 2), !, u (n K )

define

seqncia

de

vetores

(n 1), (n 2), !, (n K ) obtidos pelo mapeamento no-linear M K definido

pela Equao (5.69).

43

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

Assim, apesar de definidos em uma dimenso diferente da dimenso original dos

vetores t k M de estados da srie S, e apesar de obtidos atravs de uma transformao

no-linear

entre

as

dimenses

K ,

(n 1), (n 2), !, (n K ) definidos em K ainda

conjunto

de

vetores

armazena informao sobre o

desenrolar temporal da srie. Portanto, os vetores em K contm informao implcita

sobre os estados de S, definidos agora em uma outra dimenso, com S sendo vista atravs

de um processo no-linear. Assim, o conjunto de vetores em K pode ser agrupado em

uma matriz de transio de estados da srie temporal S, agora interpretada como um

processo no-linear com K estados K dimensionais.

A matriz de transio de estados da srie temporal S, tomada como um processo

no-linear com K estados K dimensionais no instante n, mostrada na Equao (5.71).

(n 1)T 0 (n 1) 1 (n 1) ! K 1 (n 1)

(n 2)T 0 (n 2) 1 (n 2) ! K 1 (n 2)

(n ) =

=

"

"

"

"

T

(n K ) 0 (n K ) 1 (n K ) ! K 1 (n K )

(5.71)

Note que as linhas de (n ) correspondem aos vetores de transio de estado

(n 1)T , (n 2)T , !, (n K )T

do

processo

no-linear,

os

quais

resultam

respectivamente da aplicao dos vetores u (n 1), u (n 2), !, u (n K ) entrada da rede

RBF.

Note tambm, da transformao (5.69), que o k-simo componente do vetor

(n ) K , arbitrrio, tende para o valor mximo 1.0 medida em que o vetor

u (n ) M aplicado entrada da rede RBF tende para o vetor de estado t k da k-sima

funo de base radial. Portanto, (5.69) uma transformao no-linear de M K que

44

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

mede o quanto o desenrolar temporal momentneo da srie S se relaciona com os K estados

bsicos do processo ela associado.

Para um vetor de pesos sinpticos arbitrrio w = wa , o conjunto de sadas ou o vetor

de sadas y (n ) para (n ) dado obtido por

y (n ) = (n ). w a

com

(5.72)

y (n ) = [y (n 1) y (n 2 ) ! y (n K ) ]

(5.73)

onde y (n 1), y (n 2 ),!, y (n K ) so as sadas da rede RBF com respeito aos vetores de

entrada u (n 1), u (n 2 ),!, u (n K ) associados ao desenrolar temporal momentneo da

srie S, sendo dados o vetor de pesos sinpticos arbitrrio w = wa e a matriz de estados

(n ) .

Vamos supor que y (n ) = d (n ) , onde d (n ) o vetor de sadas desejadas definido por

d (n ) = [u (n ) u (n 1) ! u (n K + 1)] conforme construo mostrada na Figura 5.7, de tal

T

forma que

u (n )

u (n 1)

= (n ). w(n ) =

y (n ) = d (n ) =

"

u (n K + 1)

(5.74)

0 (n 1) 1 (n 1) ! K 1 (n 1) w0 (n )

(n 2 ) (n 2 ) ! (n 2 ) w (n )

0

1

K 1

1

"

"

"

"

0 (n K ) 1 (n K ) ! K 1 (n K ) wK 1 (n )

Observe-se que cada elemento em d (n ) o elemento que se coloca uma posio

frente na srie S, com respeito ao vetor de entrada que gerou o correspondente vetor de

transio de estado no-linear em . Por exemplo, a primeira linha de na Equao

45

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

(5.74) o vetor de transio de estado no-linear (n 1) que resulta da aplicao do

T

vetor u (n 1) entrada da rede neural. A sada desejada correspondente a este vetor de

entrada o elemento u (n ) de d (n ), que se encontra uma posio frente na srie S, com

respeito ao vetor u (n 1) , conforme pode ser observado na Figura 5.7.

Portanto, atravs da transformao linear definida pelo vetor de pesos sinpticos

w(n ) K e atravs da transformao no-linear definida pela matriz (n ) , a Equao

(5.74) implicitamente relaciona cada vetor u (n k 1) formado da janela

p (n) ,

k = 0,1,!, K 1 , com o elemento u (n k ) de S, sendo u (n k ) o elemento que est

localizado na srie S uma posio frente do vetor u (n k 1).

Assim,

uma vez determinado, w(n ) conter informao de como se efetua a

transio partindo dos estados prvios do processo de S at o prximo elemento de S

imediatamente adiante ao respectivo vetor u (n k 1) representativo do desenrolar

temporal momentneo de S .

importante ressaltar que a informao de transio em w(n ) resultante de uma

transformao no-linear M K , e, em conseqncia disto, uma informao que

envolve as estatsticas de ordem superior do processo de S . Em funo disto, o mtodo de

predio no-linear aqui apresentado potencialmente mais capaz de captar as sutilezas

estatsticas do processo estocstico subjacente em S do que o mtodo de predio linear

baseado em estatsticas de segunda ordem visto na Seo 5.2.1.

A obteno de w(n ) definida pela Equao (5.75).

w(n ) = 1 (n ) d (n )

(5.75)

Neste estudo, a inversa da matriz obtida pela pseudo-inverso matricial de

Moore-Penrose [6], atravs de decomposio em valores singulares SVD. Embora a

SVD minimize o problema da eventual singularidade de e,

embora toda a srie

temporal seja normalizada para o intervalo [1,1] , antes de qualquer procedimento, por

46

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

precauo, adiciona-se o valor 1 10 9 diagonal principal de , como um parmetro de

regularizao [6], visando auxiliar o tratamento das singularidades da matriz .

Vamos agora efetuar o processo de predio propriamente dito. Uma vez obtido

w(n ) de (5.75), aplica-se o vetor u (n ) = [u (n ), u (n 1), !, u (n M + 1)] entrada da rede

T

neural. O vetor peso sinptico w(n ) obtido de (5.75) armazena informao de como ocorre

a transio estados prviosprximo elemento dado o vetor de entrada que descreve o

desenrolar temporal momentneo da srie S. Como, por definio, uma varivel de estado

no sofre alterao para uma variao pequena no sistema por ela descrito [3], assume-se

que os vetores de estado t k do processo de S no sofram uma mudana significativa uma

posio frente em S. Assim, a sada da rede neural y (n ) ao vetor de entrada

u (n ) = [u (n ) u (n 1) ! u (n M + 1)]

ser uma estimativa u (n + 1) ou predio da

amostra u (n + 1) , dada pela Equao (5.76) com base em (5.64):

u (n ) t (n ) 2

k

u (n + 1) = y (n ) = wk (n )exp

2

k =0

max t i (n ) t j (n )

K 1

K 1

(5.76)

= wk (n ) k (n ) = w (n ) (n )

T

k =0

Em outras palavras, se est implicitamente deslizando a matriz uma posio

frente ao longo de S, assumindo que os estados armazenados em permanecem

inalterados e usando-se a informao de transio armazenada em w para estimar o

prximo elemento em S, a partir dos estados definidos em . Obviamente, K deve ser

grande o suficiente para que

possa armazenar todos os estados significativos. Da

mesma forma, a dimenso M dos vetores de estado do processo de S

deve ser

suficientemente grande para representar os estados significativos do processo.

Esta tcnica de predio no-linear atravs de redes neurais artificiais do tipo RBF

com atribuio de centros definida pela Equao (5.67) doravante ser referida como

predio com base na Atribuio Padro dos Centros (APC).

47

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

5.2.2.1 Sumrio da Heurstica APC para Predio No-Linear de

Sries Temporais via RNAs RBF

I Inicializao:

1.

Posicionar p(n = 0 ) de N elementos, sobre S.

2.

Definir K e M , ( N = K + M ) a partir de p(n ) .

3.

Formar vetores-centro t k (n ) M das funes de base radial.

4.

Formar vetores u (n ) M , = 0,1, ! , K do conjunto de treino.

II - Treinamento:

1.

Apresentar todos os vetores do conjunto de treino entrada da rede

RBF (exceto o vetor que contm as informaes mais recentes sobre

S, o v e t o r u (n) ), o b t e n d o p a r a c a d a u m d o s d e m ai s

v e t o r e s u (n ) M , = 1, ! , K o c o r r e s p o n d e n t e v e t o r

(n ) K , = 1,! , K .

2.

Construir (n ) a partir dos vetores (n ) .

3.

Formar vetor sada desejada d (n ) = [u (n ) u (n 1) ! u (n K + 1)] ,

atribuindo a cada vetor (n ) uma sada desejada equivalente ao

ltimo componente do vetor u (n + 1) .

4.

Determinar vetor de pesos sinpticos w(n ) = 1 (n ) d (n ) .

48

PUCRS - FENG - DEE - Mestrado em Engenharia Eltrica

Redes Neurais Artificiais

Fernando Csar C. de Castro e Maria Cristina F. de Castro

5.

Aplicar vetor u (n ) entrada da RBF, obtendo na sada

2

u (n ) t k (n )

u (n + 1) = wk (n )exp

2

k =0

t i (n ) t j (n )

(n )max

i, j

K 1

5.2.2.2

= wT (n ) (n )

(deslizando p(n ) uma posio frente em S).

6.

n = n +1

7.

Obtida a nova janela, voltar ao passo 3 da etapa de inicializao.

Predio No-Linear de Sries Temporais: Exemplo

Nesta seo so apresentados os resultados obtidos para a predio no-linear

atravs da heurstica APC da mesma srie utilizada na Seo 5.2.1.2 (Predio Linear de

Sries Temporais: Exemplo), a srie Chaotic_LASER, com N t = 1000 amostras.

Por coerncia, foi adotada a mesma ordem de predio adotada no caso da predio

linear, M = 11 , e K = 8 vetores centros, necessitando portanto, de N = K + M = 19

amostras conhecidas, anteriores amostra u (n + 1) que se deseja predizer.

Para o Fator de Varincia utilizou-se = 1.0 .

O resultado da predio no-linear para este caso mostrado na Figura 5.8.