Tesis

Diunggah oleh

Sanchez Enriquez HeiderJudul Asli

Hak Cipta

Format Tersedia

Bagikan dokumen Ini

Apakah menurut Anda dokumen ini bermanfaat?

Apakah konten ini tidak pantas?

Laporkan Dokumen IniHak Cipta:

Format Tersedia

Tesis

Diunggah oleh

Sanchez Enriquez HeiderHak Cipta:

Format Tersedia

UNIVERSIDAD NACIONAL DE TRUJILLO

FACULTAD DE CIENCIAS F

ISICAS Y MATEM

ATICAS

ESCUELA DE INFORM

ATICA

DESARROLLO DE UN M

ETODO PARA LA

CLASIFICACI

ON AUTOM

ATICA

DE ARCHIVOS MUSICALES USANDO LA T

ECNICA BAG

OF WORDS

Tesis presentada para obtener el t

tulo de

INGENIERO INFORM

ATICO

Autores:

S

anchez Enriquez, Heider Ysa

as

Rodr

guez Maysundo, Eduardo

Asesor:

Castillo Diestra, Carlos Enrique

2011

Indice general

RESUMEN 8

ABSTRACT 9

1. INTRODUCCI

ON 10

1.1. Planteamiento del problema . . . . . . . . . . . . . . . . . . . . . . . . . . 10

1.2. Objetivos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 11

1.2.1. Objetivo General . . . . . . . . . . . . . . . . . . . . . . . . . . . . 11

1.2.2. Objetivos Especcos . . . . . . . . . . . . . . . . . . . . . . . . . . 11

1.3. Descripci on del trabajo . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 12

1.4. Antecedentes Previos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 13

1.5. Organizaci on del trabajo . . . . . . . . . . . . . . . . . . . . . . . . . . . . 14

2. FUNDAMENTOS DE LA M

USICA 16

2.1. Resumen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 16

2.2. Sonido . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 16

2.2.1. Magnitudes Fsicas . . . . . . . . . . . . . . . . . . . . . . . . . . . 16

2.3. Sonidos Musicales . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 18

2.3.1. Caractersticas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 18

2.4. Genero Musical . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 21

2.4.1. Clasicacion . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 21

3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 24

3.1. Resumen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 24

3.2. Digitalizaci on de la Se nal . . . . . . . . . . . . . . . . . . . . . . . . . . . . 25

3.2.1. Se nal Digital . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 25

3.2.2. Muestreo . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 25

3.2.3. Cuantizaci on . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 27

3.3. Representacion en el dominio de Frecuencias . . . . . . . . . . . . . . . . . 27

3.3.1. Transformada Discreta de Fourier . . . . . . . . . . . . . . . . . . . 28

2

Indice general 3

3.3.2. Transformada R apida de Fourier (FFT) . . . . . . . . . . . . . . . 29

3.3.3. Enventanado . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 31

3.3.4. Transformada Discreta del Coseno . . . . . . . . . . . . . . . . . . . 33

3.3.5. Filtrado de la Se nal . . . . . . . . . . . . . . . . . . . . . . . . . . . 33

4. T

ECNICAS DE EXTRACCI

ON DE CARACTER

ISTICAS 38

4.1. Resumen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 38

4.2. Mel Frecuency Cepstral Coecients (MFCC) . . . . . . . . . . . . . . . . . 38

4.2.1. Cepstrum . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 39

4.2.2. Calculo de los Coecientes Mel . . . . . . . . . . . . . . . . . . . . 40

4.3. Caractersticas en Tramas de Tiempo Especializadas . . . . . . . . . . . . 44

4.4. C alculo del Pitch . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 46

4.4.1. Esquema del Algoritmo . . . . . . . . . . . . . . . . . . . . . . . . . 47

4.5. Vector Descriptor . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 49

5. CLASIFICACI

ON CON MAQUINAS DE SOPORTE VECTORIAL 50

5.1. Resumen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 50

5.2. Denici on . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 50

5.3. Clasicaci on para datos linealmente separables . . . . . . . . . . . . . . . . 52

5.4. Clasicaci on para datos linealmente no separables . . . . . . . . . . . . . . 53

5.5. Clasicaci on para datos no lineales . . . . . . . . . . . . . . . . . . . . . . 55

5.6. Clasicaci on m ultiple . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 56

6. DESARROLLO DEL M

ETODO 58

6.1. Resumen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 58

6.2. Bag of Word: Estado del Arte . . . . . . . . . . . . . . . . . . . . . . . . . 59

6.2.1. BoW en la Clasicacion de documentos . . . . . . . . . . . . . . . . 59

6.2.2. BoW en la Clasicacion de Imagenes . . . . . . . . . . . . . . . . . 59

6.3. BoW para la Clasicaci on Automatica de Archivos Musicales . . . . . . . . 60

6.3.1. Extraccion de Caractersticas . . . . . . . . . . . . . . . . . . . . . 61

6.3.2. Elaboraci on del diccionario . . . . . . . . . . . . . . . . . . . . . . . 61

6.3.3. Generacion del Histograma de Cl uster (HoC) . . . . . . . . . . . . . 65

6.3.4. Clasicacion . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 66

7. ENTRENAMIENTO DEL MODELO 67

7.1. Resumen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 67

7.2. Herramientas de Implementaci on . . . . . . . . . . . . . . . . . . . . . . . 67

7.2.1. Libreras de Audio . . . . . . . . . . . . . . . . . . . . . . . . . . . 68

7.2.2. Librera para las SVM: LibSVM . . . . . . . . . . . . . . . . . . . . 69

Indice general 4

7.3. Base de Datos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 70

7.4. M odulos de Entrenamiento . . . . . . . . . . . . . . . . . . . . . . . . . . . 70

7.4.1. Modulo de Descriptores . . . . . . . . . . . . . . . . . . . . . . . . 70

7.4.2. Modulo de Agrupamiento . . . . . . . . . . . . . . . . . . . . . . . 71

7.4.3. Modulo de Histograma de Entrenamiento . . . . . . . . . . . . . . . 71

7.4.4. Modulo de Clasicacion SVM . . . . . . . . . . . . . . . . . . . . . 72

8. EVALUACI

ON Y RESULTADOS 73

8.1. Resumen . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 73

8.2. Base de Datos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 73

8.3. M odulos de Evaluacion . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 73

8.3.1. Modulo de Histograma de Evaluacion . . . . . . . . . . . . . . . . . 73

8.3.2. Modulo de Prediccion SVM . . . . . . . . . . . . . . . . . . . . . . 74

8.4. Evaluando la Mejor Medida de Distancia . . . . . . . . . . . . . . . . . . . 74

8.5. Experimentos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 75

8.5.1. Evaluando el N umero de Cl usteres . . . . . . . . . . . . . . . . . . 76

8.5.2. Evaluando el kernel de clasicaci on . . . . . . . . . . . . . . . . . . 78

9. CONCLUSIONES Y RECOMENDACIONES 84

9.1. Conclusiones . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 84

9.2. Recomendaciones . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 86

Indice de guras

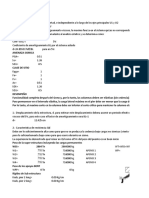

1.1. Esquema del proceso para la clasicacion de archivos musicales . . . . . . . 15

2.1. Longitud de Onda en una sinusoide . . . . . . . . . . . . . . . . . . . . . . 17

2.2. Ejemplos de ondas de distintas frecuencias . . . . . . . . . . . . . . . . . . 17

2.3. Amplitud de una onda sonora . . . . . . . . . . . . . . . . . . . . . . . . . 18

2.4. Sonido agudo, mayor frecuencia (izquierda). Sonido grave, menor frecuencia

(derecha) [BEE09] . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 19

2.5. Sonido fundamental [BEE09]. . . . . . . . . . . . . . . . . . . . . . . . . . 20

2.6. Sonido complejo [BEE09]. . . . . . . . . . . . . . . . . . . . . . . . . . . . 20

2.7. Sonido fuerte, mayor amplitud de onda (izquierda). Sonido suave, menor

amplitud de onda (derecha) [BEE09]. . . . . . . . . . . . . . . . . . . . . . 21

2.8. Ejemplos de niveles sonoros en dB respecto al umbral de audici on [HJ06]. . 21

2.9. Jerarqua de clasicaci on de generos musicales [TC02]. . . . . . . . . . . . 23

3.1. Paso de se nal Anal ogica a Digital y Digital a Analogica . . . . . . . . . . . 25

3.2. El Proceso de muestreo [JR05]. . . . . . . . . . . . . . . . . . . . . . . . . 26

3.3. Representacion conceptual del proceso de la digitalizaci on de la se nal anal ogi-

ca . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 27

3.4. Etapas de digitalizaci on: Se nal original (izquierda), Se nal muestreada con

amplitudes analogicas (derecha), Se nal digital (abajo) [WS99]. . . . . . . . 28

3.5. Gr aca en el dominio del tiempo (izquierda) y su correspondiente en fre-

cuencias (derecha) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 29

3.6. Esquema para una se nal de N=8 puntos [wikipedia]. . . . . . . . . . . . . . 31

3.7. Solapamiento de ventanas . . . . . . . . . . . . . . . . . . . . . . . . . . . 32

3.8. Representacion graca de los tipos de Ventanas [wikipedia]. . . . . . . . . . 35

3.9. Espectro de las distintas ventanas [SV05] . . . . . . . . . . . . . . . . . . . 36

3.10. Izquierda, la ventana Haming (azul) y la se nal original (rojo). Derecha, la

se nal resultante de la multiplicaci on [SV05] . . . . . . . . . . . . . . . . . . 36

3.11. Representaci on de la DTC- I (a), DTC-II (b), DTC-III (c) y DTC-IV (d)

respectivamente [HAH01]. . . . . . . . . . . . . . . . . . . . . . . . . . . . 36

5

Indice de guras 6

3.12. Tipos de ltros [VW99] . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 37

4.1. Representacion del tracto vocal h(n) como un ltro lineal variable en el

tiempo . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 39

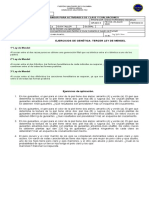

4.2. Diagrama de bloques del algoritmo de front-end seg un el est andar ETSI

ES 201 108 [ETSI00] . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 40

4.3. Escala Mel con 5 Bins . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 43

4.4. Filtro triangular con altura 1 . . . . . . . . . . . . . . . . . . . . . . . . . 43

5.1. Esquema de aplicacion de las SVM [GA05]. . . . . . . . . . . . . . . . . . . 51

5.2. Muestra del hiperplano que dos clases linealmente separables . . . . . . . . 52

5.3. Muestra del hiperplano que dos clases linealmente no separables . . . . . . 54

5.4. Mapeo a un espacio caracterstico para datos no linealmente separables . . 55

6.1. Proceso clasico de clasicacion de patrones de audio. . . . . . . . . . . . . 58

6.2. Incorporando la tecnica Bag of Word al proceso clasico de clasicacion. . . 58

6.3. C alculo del Vector Cuantizacion de una cancion. . . . . . . . . . . . . . . 59

6.4. Frecuencia de palabras en un texto. . . . . . . . . . . . . . . . . . . . . . 60

6.5. Histograma de Frecuencia de palabras. . . . . . . . . . . . . . . . . . . . . 60

6.6. Clasicaci on de documentos por Histograma de Frecuencias. . . . . . . . . 61

6.7. Clasicaci on de im agenes con m ultiples BoW [BCS09]. . . . . . . . . . . . 62

6.8. BoW, Etapas de Entrenamiento. . . . . . . . . . . . . . . . . . . . . . . . 62

6.9. BoW, Etapas de Evaluacion. . . . . . . . . . . . . . . . . . . . . . . . . . . 63

6.10. Descriptores de un archivo musical. . . . . . . . . . . . . . . . . . . . . . . 63

6.11. Agrupamiento con k-medias de los vectores descriptores de cada archivo

musical de entrenamiento. . . . . . . . . . . . . . . . . . . . . . . . . . . . 64

6.12. Histograma de Cl uster de un archivo musical . . . . . . . . . . . . . . . . . 65

7.1. Categoras de clasicaci on de archivos musicales consideradas en este trabajo 68

7.2. Java Sound API para digitalizar se nal analogica . . . . . . . . . . . . . . . 69

7.3. Arquitectura de la Librera de JavaLayer para descomprimir MP3 [Java-

Zoom]. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 69

8.1. Gr aco Resumen de la evaluaci on del n umero de cl usteres . . . . . . . . . 80

8.2. Gr aco Resumen de la evaluaci on del n umero de cl usteres . . . . . . . . . 82

Indice de cuadros

3.1. Tipos de Ventanas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 32

8.1. Resultado de la Mejor Medida de Distancia . . . . . . . . . . . . . . . . . . 76

8.2. Matriz de Confusion Porcentual . . . . . . . . . . . . . . . . . . . . . . . . 76

8.3. Resultado Experimental con 50 cl usteres . . . . . . . . . . . . . . . . . . . 77

8.4. Resultado Experimental con 100 cl usteres . . . . . . . . . . . . . . . . . . 78

8.5. Resultado Experimental con 150 cl usteres . . . . . . . . . . . . . . . . . . 79

8.6. Cantidad de Vectores de Soporte por cada experimento . . . . . . . . . . . 79

8.7. Resultado Experimental con Kernel Sigmoide . . . . . . . . . . . . . . . . 80

8.8. Resultado Experimental con Kernel Lineal . . . . . . . . . . . . . . . . . . 81

8.9. Resultado Experimental con Kernel Polin omica . . . . . . . . . . . . . . . 81

8.10. Resultado Experimental con Kernel RBF . . . . . . . . . . . . . . . . . . . 82

8.11. Resultado general del porcentaje de acierto aplicando el metodo desarrollado 83

7

RESUMEN

Los archivos musicales presentan diversas caractersticas relacionados al timbre, la to-

nalidad y la rtmica; adem as considerando la enorme variedad de m usica existente, surge la

necesidad de poder clasicar y organizar las canciones incluyendo criterios no comunes en

los reproductores de audio convencionales. Dichas clasicaciones son posibles si aplicamos

la extracci on de caractersticas a la se nal digital del audio, de tal manera que podamos

obtener un patr on lo sucientemente caracterstico que servira para el entrenamiento de

un modelo clasicador.

El presente trabajo muestra el desarrollo de un metodo para la clasicaci on autom atica de

archivos musicales, que incorpora una fase medi atica entre la extracci on de caractersti-

cas y el clasicador, utilizando la tecnica Bag of Word. Esta tecnica trata de hallar un

histograma de distribuci on del conjunto de vectores de caractersticas en un espacio de

dimensi on mayor; este histograma ser a nuestro patron de caractersticas del archivo mu-

sical. Para la clasicaci on y reconocimiento de los patrones utilizamos las Maquinas de

Soporte Vectorial (SVM).

Usando el metodo propuesto obtuvimos un acierto de 80.65 % aplicados a una base de

4500 piezas musicales en formato MP3.

8

ABSTRACT

Music les have dierent features related to the sound, pitch and rhythm; besides

considering the enormous variety of existing music, the need arises to classify and orga-

nize songs including criteria that are not common in conventional audio players. These

classications are possible if we apply feature extraction to digital audio, so we can get a

pattern, which has a characteristic good enough to be used to train a classier model.

This project shows the development of a method to the automatic sorting of music -

les, which incorporates a media stage between feature extraction and classier, using the

technique Bag of Word. This technique tries to nd a distribution histogram of all feature

vectors in a space of higher dimension, this histogram will be our standard features music

le. For the classication and pattern recognition, we use the Support Vector Machines

(SVM).

Using this method, we obtained an accuracy of 80.65 % applied to a 4500 pieces of music

in MP3 format.

9

Captulo 1

INTRODUCCI

ON

1.1. Planteamiento del problema

Desde hace un buen tiempo la producci on musical sigue aumentando considerable-

mente, debido al incremento de factores tecnol ogicos tales como: la alta compresi on de

datos de los formatos musicales, el rapido crecimiento de la capacidad de almacenamien-

to de los dispositivos, desarrollo desenfrenado del software inform atico para la gestion y

reproducci on de m usica digital, entro otros.

La forma com un para clasicar los archivos musicales dentro de una biblioteca musical se

basa en la edicion del encabezado del archivo (metadatos), esto quiere decir que se deben

de proporcionar datos como: ttulo de la canci on, genero, nombre del album, interpre-

te, etc. Los cuales deben editarse de forma manual, trayendo consigo resultados no muy

favorables si queremos clasicar nuestras canciones obedeciendo a ciertos criterios de an ali-

sis de contenido. Como ejemplos cl asicos tenemos a los reproductores convencionales de

m usica como Winamp, Aimp2 y Windows Media Player. Aunque ya se comercializan re-

productores relativamente inteligentes que incorporan la clasicaci on automatica, pero su

uso aun no es com un en nuestro medio.

La necesidad de clasicar los archivos musicales seg un diversos criterios como puede ser:

por genero musical (hip hop, metal, rock, jazz, etc.), por discriminaci on de voz (con voz,

sin voz), por tipo de sonido (mesuradas, energicas), por genero de interprete (hombre,

mujer, ni no) y generacion de listas inteligentes basados en la similitud del contenido,

permitiendo realizar una selecci on de mucha utilidad para el usuario; es un problema de

actual investigaci on conocida como Clasicaci on Automatica del Audio.

Por ello en este trabajo de tesis pretendemos desarrollar un metodo alternativo para re-

solver el problema de la clasicaci on de archivos musicales orientandonos principalmente

a la clasicacion por genero musical, discriminaci on de voz y tipo de sonido. Concen-

traremos la investigacion en la adaptacion de la tecnica Bag of Word(aplicada en la

10

Captulo 1. INTRODUCCI

ON 11

clasicaci on de im agenes) a se nales de audio, y utilizaremos tecnicas de aprendizaje au-

tom atico de maquinas (SVM, M aquina de soporte Vectorial) para el entrenamiento de

nuestro modelo.

Normalmente los archivos musicales tienen una duraci on de reproduccion mayor a 3 mi-

nutos implicando de manera proporcional a la longitud de la se nal del audio, Esto quiere

decir que habr a un alto coste de procesamiento (Tiempo de Ejecuci on y espacio en memo-

ria) debido al gran tama no del vector digitalizado de la se nal, por ejemplo probando en

una PC Corel 2 Duo de 2.4 Ghz y Memoria Ram de 2 GB para aplicar la Transformada

R apida de Furier a un archivo de voz en formato WAV de 25 KB el tiempo de ejecuci on

es de 100 ms y para un archivo musical de 4 Mb es de 16105 ms (16 segundos aprox.)

ocupando 4096 KB de memoria RAM.

Una opci on interesante encontrada en la literatura seria no trabajar con todo el vector

sino con un resumen caracterstico [Gabriela, Virginia y Laura, 2005], lo cual al ser es-

tudiada redunda con las mismas tecnicas utilizadas posteriormente en la extraccion de

caractersticas. Otra alternativa mas consistente para nuestro prop osito es la de extraer

un conjunto de descriptores caractersticos de toda la se nal ubicando puntos de interes

estrategicos [Georoy y Xavier, 2002], siendo parte de nuestra investigaci on la identica-

ci on de aquellos puntos de interes.

Ante lo expuesto, el problema que vamos a abordar en el presente trabajo es: Cu ales

son los resultados de Clasicaci on si aplicaramos la tecnica Bag of Word al conjunto de

descriptores obtenidos y su entrenamiento con SVM sobre archivos musicales?, el cual

busca ser un aporte en la Clasicaci on Autom atica del Audio.

1.2. Objetivos

1.2.1. Objetivo General

Lograr el desarrollo de un metodo para la clasicaci on autom atica de archivos musi-

cales utilizando ecazmente la tecnica Bag of Word y la Maquina de Soporte Vectorial de

tal manera que permita realizar consultas ecientes.

1.2.2. Objetivos Especcos

Analizar el proceso de extracci on de caractersticas de una se nal de audio para su

utilizaci on en la Clasicacion Autom atica.

Analizar el funcionamiento de la Maquina de Soporte vectorial (SVM) para el en-

trenamiento y clasicacion de patrones de audio.

Captulo 1. INTRODUCCI

ON 12

Dise nar el metodo para la clasicaci on automatica de archivos musicales con la

tecnica Bag of Word.

Realizar las pruebas necesarias para demostrar que el metodo desarrollado cumple

los objetivos planteados.

1.3. Descripcion del trabajo

Para poder lograr el objetivo planteado, en el proceso de desarrollo abordaremos diver-

sos temas de estudio relacionados al procesamiento de se nales digitales y reconocimiento

de patrones. El presente trabajo est a dividido b asicamente en 3 partes:

En la primera parte procesaremos la se nal digitalizada y extraeremos un conjunto de

descriptores en intervalos cortos de tiempo, empleando las siguientes tecnicas:

Relacionados a la Textura Tmbrica:

MFCC: Coecientes Cepstrales en Frecuencia Mel.

Caractersticas en Tramas de Tiempo Especializadas.

Relacionados al Tono Musical:

C alculo del PITCH del Audio.

La cantidad de descriptores por archivo vara seg un la duraci on de la canci on, adem as

se necesita compactar todos estos descriptores a un solo vector caracterstico de mayor

dimensi on.

En la segunda parte trataremos de adecuar la tecnica Bag of Word para reducir nuestro

conjunto de descriptores en un solo vector. Dicha tecnica indica que debemos agrupar

todos los descriptores de nuestra base de entrenamiento aplicando un algoritmo de agru-

pamiento (en nuestro caso utilizamos K-means), de tal manera que podamos obtener los

mejores Centroides de cada cl uster. Luego se obtiene por cada archivo un histograma de

incidencias a cada cl uster, de dimensi on igual a la cantidad de cl usteres utilizados en la

agrupaci on.

En la tercera parte entrenaremos nuestro modelo utilizando las Maquinas de Soporte Vec-

torial para la Clasicaci on, los histogramas obtenidos ser an los datos de entrada para el

SVM y se seleccionar a los mejores par ametros de entrenamiento para un optimo resultado.

En la gura 1.1 se puede visualizar el esquema para la clasicaci on de archivos musi-

cales.

Captulo 1. INTRODUCCI

ON 13

1.4. Antecedentes Previos

La clasicaci on de audio y/o sonido ha surgido con interesantes investigaciones en los

ultimos a nos. Su antecedente principal son los trabajos de Consulta por Tarareo (Ghia-

set, 1995) dando inicios a la necesidad de modelos de clasicaci on inteligente de los datos

de audio. Kurth y Clausen (2001) propusieron un metodo de indexacion autom atica en

espacios metricos para la recuperaci on de audio.

Para el a no 2002, en el evento denominado IEEE TRANSACTIONSONSPEECH AND

AUDIO PROCESSING George y Perry miembros de la IEEE presentaron uno de los

primeros trabajos sobre la clasicaci on autom atica de se nales de audio en una jerarqua

de generos musicales. George y Perry (2002) propusieron 3 conjuntos de patrones para la

representaci on: la textura tmbrica, el contenido rtmico y el contenido del Pitch. Logran-

do una clasicaci on de 61 % de acierto considerando 10 generos musicales.

Tambien en ese mismo a no la European I.S.T presenta un nuevo proyecto denominado

CUIDADO para la gestion de base de datos incluyendo un sistema de clasicaci on au-

tom atica de sonido basado en Taxonomas para la eleccion de descriptores de la se nal y

para llevar a cabo la clasicaci on, emplean el Modelo de Mezclas Gaussianas (GMM) . El

GMM es una de las primeras tecnicas en mostrar muy buenos resultados en la clasica-

ci on de datos de audio y existen muchas publicaciones que emplean esta tecnica para la

clasicaci on automatica.

Por otro lado el empleo de las Maquinas de Soporte Vectorial (SVM) para la clasicaci on

de se nales de audio se viene empleando fuertemente dentro de los trabajos de Clasicaci on

de patrones, y esta convirtiendose en la tecnica m as eciente en el campo de la clasica-

ci on autom atica de audio.

Ingo y Katharina (2004), presentan un marco unicado de extracci on y clasicaci on; ellos

utilizaron una estructura de arboles espaciales para la construccion automatica de secuen-

cias de transformaciones de datos desde el enfoque de la programaci on genetica, adem as

emplearon las Maquina de Soporte Vectorial (librera mySVM) para la clasicaci on por

aprendizaje. Este modelo se aplic o a la clasicaci on musical por generos musicales.

Olivier y Gael (2008), en su trabajo denominado Transcription and Separation of Drum

Signals From Polyphonic Music dise na un estructura para la estimacion de la probabi-

lidad a posteriori, basado en el clasicador C-Support Vector Machines (C-SVM), como

datos de entrenamiento utiliza un subconjunto de archivos independientes a la base de

datos de evaluacion, obteniendo resultados sobre el 70 % de acierto.

Captulo 1. INTRODUCCI

ON 14

1.5. Organizaci on del trabajo

El presente trabajo se compone de 9 captulos los cuales constituyen el cuerpo de

la tesis. A continuacion se presenta de manera breve el contenido de cada uno de estos

captulos para que el lector pueda tener una idea panor amica y global del an alisis que se

efect ua en cada uno de ellos.

Captulo 2- Fundamentos de la M usica: Conceptos y Propiedades importantes de carac-

terizaci on musical.

Captulo 3- Procesamiento Digital de Se nales de Audio: Conceptos previos de trata-

miento de la se nal que ser an utilizados en las tecnicas que se describen en el captulo 4.

Captulo 4- Tecnicas de Extraccion de Caractersticas: Estudio y An alisis de las tecni-

cas para extraer los parametros de caracterizaci on de los archivos musicales, estrategicas

empleadas para optimizar dichos par ametros.

Captulo 5 - Clasicaci on con M aquinas De Soporte Vectorial: Importante para la fase

de entrenamiento.

Captulo 6- Dise no del Metodo: An alisis de la tecnica Bag of Words en la clasicacion

de documentos e Im agenes. Aqu se plantea Bag of Words para su aplicaci on en la clasi-

caci on de archivos musicales.

Captulo 7- Entrenamiento del Modelo: Se especica el marco experimental, las herra-

mientas utilizadas y los par ametros inciales.

Captulo 8- Evaluacion y Resultados: Evaluaremos el metodo dise nado con una base de

datos de archivos musicales de diferentes categoras de clasicaci on.

Captulo 9- Conclusiones y Recomendaciones.

Captulo 1. INTRODUCCI

ON 15

Figura 1.1: Esquema del proceso para la clasicacion de archivos musicales

Captulo 2

FUNDAMENTOS DE LA M

USICA

2.1. Resumen

La m usica es denida como el arte de organizar coherentemente un conjunto de sonidos

y silencios con el n de obtener un sonido agradable al odo, armonioso y mel odico. Pero

desde tiempos antiguos ha sido conceptualizada tambien como una ciencia exacta que

obedece a las leyes denidas y se fundamenta en los principios del sonido. A continuaci on

estudiaremos ciertos conceptos relevantes para comprender las tecnicas que se utilizaran

en el desarrollo del metodo.

2.2. Sonido

Desde un punto de vista fsico, el sonido es una vibracion que se propaga en un medio

el astico (s olido, lquido o gaseoso), generalmente el aire. Cuando nos referimos al sonido

audible por el odo humano, lo denimos como una sensaci on percibida en el organo del

odo, producida por la vibraci on de las partculas que se desplazan (en forma de onda

sonora) a traves de un medio el astico que las propaga en forma de ondas.

Para que se produzca un sonido es necesaria la existencia de: un emisor o cuerpo vi-

brante, un medio el astico transmisor de esas vibraciones y un receptor que capte dichas

vibraciones.

2.2.1. Magnitudes Fsicas

Como todo movimiento ondulatorio, el sonido puede representarse como una suma

de curvas sinusoidales con un factor de amplitud, que se pueden caracterizar por las

mismas magnitudes y unidades de medida que cualquier onda de frecuencia bien denida:

Longitud de onda, frecuencia, amplitud, volumen y potencia ac ustica.

16

Captulo 2. FUNDAMENTOS DE LA M

USICA 17

Longitud de Onda: Es la distancia que recorre la onda en el intervalo de tiempo trans-

currido entre dos picos consecutivos (gura 2.1). Se representa por la letra griega .

Seg un el Sistema Internacional (SI) su unidad de medida es el metro (m).

Figura 2.1: Longitud de Onda en una sinusoide

Frecuencia: La frecuencia es una medida que se utiliza generalmente para indicar el

n umero de repeticiones de cualquier fen omeno o suceso periodico en la unidad de

tiempo. Para calcular la frecuencia de un suceso, se contabilizan un n umero de ocu-

rrencias de este, teniendo en cuenta un intervalo temporal, luego estas repeticiones

se dividen por el tiempo transcurrido (gura 2.2).

Seg un el SI su unidad de medida es en hercios (Hz). La frecuencia es la inversa del

periodo T:

f =

1

T

Figura 2.2: Ejemplos de ondas de distintas frecuencias

Amplitud: Es una medida de la variaci on m axima del desplazamiento u otra magnitud

fsica que vara periodica o cuasi peri odicamente en el tiempo. Indica la cantidad de

energa que contiene una se nal sonora ( gura 2.3).

En ac ustica la amplitud normalmente se mide en decibelios (dB).

Sin embargo, un sonido complejo cualquiera, no esta caracterizado por los par ametros

anteriores, ya que en general un sonido cualquiera es una combinacion de ondas sonoras

que dieren en los tres par ametros anteriores. La caracterizaci on de un sonido arbitra-

riamente complejo implica analizar tanto la energa transmitida como la distribucion de

dicha energa entre las diversas ondas componentes, para ello resulta util investigar la

Captulo 2. FUNDAMENTOS DE LA M

USICA 18

Figura 2.3: Amplitud de una onda sonora

potencia ac ustica y el espectro de frecuencias, que permite conocer en que frecuencias se

transmite la mayor parte de la energa.

2.3. Sonidos Musicales

El sonido en combinacion con el silencio, es la materia prima de la m usica. En m usica

los sonidos se clasican en categoras como: largos y cortos, fuertes y debiles, agudos y

graves, agradables y desagradables. El sonido ha estado siempre presente en la vida coti-

diana del hombre.

Es preciso establecer la diferencia entre un sonido y un ruido. Los sonidos son aquellos que

nos producen sensacion agradable, bien porque son sonidos musicales o porque son como

las slabas que forman las palabras, sonidos armonicos, que encierran cierto signicado

al tener el odo educado para ellos. Si se obtienen gr acas de registro de las vibraciones

de sus ondas se observa que, en general, los sonidos musicales poseen ondas casi sinusoi-

dales, aunque alteradas a veces apreciablemente por la presencia de sus arm onicos. Los

restantes sonidos arm onicos conservan todava una total periodicidad aunque su gr aca se

aleje notablemente de una sinusoide, por estar compuestos de varios grupos de ondas de

frecuencias fundamentales distintas, acompa nadas de algunos de sus arm onicos. Por otro

lado los ruidos presentan, de ordinario, gracas carentes de periodicidad y es precisamente

esta peculiaridad lo que produce que la sensacion cerebral resulte desagradable o molesta

[SJP03].

La dimension de la m usica es el tiempo y su medio de expresion es el sonido. Cada sonido

presenta sus propias caractersticas que lo hacen peculiar y diferente.

2.3.1. Caractersticas

Un sonido en general tiene cuatro caractersticas: altura, intensidad, timbre y dura-

ci on. Para la descripci on de los sonidos musicales se utilizan las tres primeras, las cuales

Captulo 2. FUNDAMENTOS DE LA M

USICA 19

corresponden exactamente a tres caractersticas fsicas: la frecuencia, la amplitud y la

composici on arm onica (forma de onda) respectivamente.

Como mencionamos todo sonido tiene una duracion, y a lo largo de esta, cualquiera de

estos tres parametros puede variar (los sonidos naturales jam as son perfectamente estables

o constantes).

A continuaci on se analizar a cada una de estas caractersticas.

Altura: La altura o Tono esta directamente relacionada con la frecuencia de oscilaci on

de una onda sonora, pero ambos terminos no son sin onimos. De hecho, muchos soni-

dos (como los percusivos) no tienen una altura denida. El motivo de esta aparente

paradoja es que, mientras la frecuencia es una propiedad fsica indisociable de todo

aquello que, como el sonido, vibra u oscila, la altura es una cualidad subjetiva que

percibimos solo en algunos sonidos [SJP03].

Lo que hace que un sonido posea o no una altura clara, es b asicamente su periodi-

cidad. Es necesario que un sonido sea aproximadamente peri odico, es decir que su

frecuencia de oscilaci on no vare (o vare poco) dentro de un determinado lapso de

tiempo, para que se llegue a percibir una altura. Si se analiza un lapso mayor de

tiempo, la frecuencia s puede variar, y en este caso, lo que se percibe son alturas

variables en el tiempo.

Por esta caracterstica el sonido puede clasicarse en agudo, medio y grave; consti-

tuye el tono del sonido ( gura 2.4). En el canto de los p ajaros destacan los sonidos

agudos, que contrasta con el rugido de un leon caracterizado por sonidos graves.

La altura se representa mediante las notas musicales: DO-RE-MI-FA-SOL-LA-SI.

Figura 2.4: Sonido agudo, mayor frecuencia (izquierda). Sonido grave, menor frecuencia

(derecha) [BEE09]

Timbre: El timbre podra denirse como el color de un sonido, y es lo que ayuda

a caracterizar y distinguir diferentes tipos de instrumentos, o a reconocer a las

personas por su voz [HJ06]. Esta caracterstica esta ligada con la forma de onda que

viene determinada por los arm onicos, que son una serie de vibraciones subsidiarias

que acompa nan a una vibraci on primaria o fundamental (gura 2.5) del movimiento

ondulatorio (especialmente en los instrumentos musicales). Normalmente, al hacer

Captulo 2. FUNDAMENTOS DE LA M

USICA 20

vibrar un cuerpo, no obtenemos un sonido puro, sino un sonido complejo (gura

2.6) compuesto de sonidos de diferentes frecuencias. A estos se les llama armonicos.

La frecuencia de los arm onicos, siempre es un m ultiplo de la frecuencia mas baja

llamada frecuencia fundamental o primer armonico. A medida que las frecuencias

son m as altas, los segmentos en vibraci on son m as cortos y los tonos musicales est an

m as pr oximos los unos de los otros.

Resumiendo, el timbre indica la forma en que la energa se distribuye entre los

distintos arm onicos y la forma en que esta distribuci on cambia en el tiempo.

Figura 2.5: Sonido fundamental [BEE09].

Figura 2.6: Sonido complejo [BEE09].

Intensidad: Esta caracterstica nos permite distinguir entre sonidos fuertes o debiles

(gura 2.7). La podemos denir como la fuerza con la que se produce un sonido.

Adem as de la amplitud en la percepcion de la intensidad, inuye la distancia a que

se encuentra situado el foco sonoro del oyente y la capacidad auditiva de este.

La intensidad depende del cuadrado de la amplitud de estas oscilaciones. La per-

cepcion de la intensidad sonora es en realidad, un fenomeno auditivo muy complejo,

mucho m as que el de la altura, y lo que sigue es una simplicaci on [SJP03].

La Dinamica es un elemento de la m usica que mide los cambios de intensidad. Las

intensidades de diferentes sonidos pueden variar, en varios millones de ordenes de

magnitud (es decir, el sonido mas intenso que podamos or, lo sera varios millones

de veces mas, que el m as tenue). En la gura 2.8 se muestran algunos valores tpicos.

Captulo 2. FUNDAMENTOS DE LA M

USICA 21

Figura 2.7: Sonido fuerte, mayor amplitud de onda (izquierda). Sonido suave, menor

amplitud de onda (derecha) [BEE09].

Figura 2.8: Ejemplos de niveles sonoros en dB respecto al umbral de audicion [HJ06].

2.4. Genero Musical

Un genero musical es una categora que re une composiciones musicales que comparten

distintos criterios de anidad. Estos criterios pueden ser especcamente musicales, como

el ritmo, la instrumentacion, las caractersticas arm onicas o melodicas o su estructura, y

tambien basarse en caractersticas no musicales, como la regi on geogr aca de origen, el

perodo historico, el contexto sociocultural u otros aspectos m as amplios de una determi-

nada cultura.

2.4.1. Clasicaci on

Problematica.- Existen diferentes problemas para la clasicaci on de los generos musi-

cales, entre los cuales mencionamos a continuaci on.

Subjetividad: Uno de los inconvenientes al agrupar m usica por generos reside en

que se trata de un proceso subjetivo que resulta muy inuido por el conoci-

miento personal y la forma de cada uno de sentir y escuchar la m usica.

Captulo 2. FUNDAMENTOS DE LA M

USICA 22

Cambio del Contexto Cultural:

Este problema afecta especialmente al concep-

to de popularidad en la clasicacion por generos. Por ejemplo, la m usica barro-

ca o renacentista, que la mayora de las personas agrupara actualmente bajo

el supra genero de m usica academica, ya que su difusion e interpretaci on

est a limitada a sectores especializados.

Relatividad: Algunos generos musicales son muy vagos, y pueden resultar relati-

vizados o ignorados por los crticos; el Post Rock, por ejemplo, es un termino

creado por Sim on Reynolds, resultando en una clasicaci on controvertida. Otro

ejemplo es la m usica de videojuegos, denida por su canal de difusi on, que

podra o no seg un el criterio que se utilice, denir un genero musical propio.

En las regiones andinas de Per u y Argentina es com un hablar del Fock Rock,

que es una combinaci on de los instrumentos folkl oricos al estilo rock.

Resistencia: La categorizaci on de la m usica, especialmente en generos muy es-

peccos o subgeneros, puede resultar difcil para los nuevos estilos emergentes

o para piezas musicales que incorporan caractersticas de m ultiples generos. Los

intentos por circunscribir grupos musicales a un genero determinado pueden

inducir a error, ya que es habitual que produzcan m usica en una variedad de

generos a lo largo de su trayectoria musical; incluso una misma pieza musical

puede estar compuesta por varios ritmos.

Algunas personas sienten que la categorizaci on de la m usica en generos se basa m as

en motivos comerciales y de mercado que en criterios musicales

Ventaja.- Resulta dicultoso trazarse un est andar de generos musicales. Pero sin em-

bargo categorizar la m usica por genero se hace necesario en una sociedad moderna

con alto grado de inuencia musical, para ello hay investigaciones importantes como

[TC02] que basandose en un estudio analtico de la se nal lograron obtener un arbol

jer arquico de clasicaci on (gura 2.9 ).

Captulo 2. FUNDAMENTOS DE LA M

USICA 23

Figura 2.9: Jerarqua de clasicacion de generos musicales [TC02].

Captulo 3

PROCESAMIENTO DIGITAL DE

SE

NALES DE AUDIO

3.1. Resumen

En este trabajo nos enfocamos a las se nales de audio en formato digital, por lo tanto

es necesaria la descripcion de conceptos b asicos del procesamiento de se nales digitales que

ser an utilizadas en las tecnicas de extracci on de caractersticas en el captulo siguiente.

En general el procesamiento digital de se nales (Digital Signal Processing, DSP) es un

area de la ingeniera que se dedica al analisis y dise no de se nales (audio, voz, imagenes o

video) en su forma discreta. Entonces el procesamiento digital de audio es un tipo de DSP

especializado en el tratamiento de la se nal de audio que involucra el estudio de algoritmos

y ciertas tecnicas involucradas, obteniendo una se nal que facilmente puede trabajarse en

un computador.

Las aplicaciones clasicas de procesamiento digital de audio trabajan sobre el mundo real,

tales como sonido y ondas de radio que se originan en forma an aloga; y como sabemos

las se nales anal ogicas son continuas en el tiempo, cambiando suavemente de un estado

a otro. Por otro lado las computadoras manejan informaci on discontinua, interpretada a

bajo nivel como una serie de n umeros binarios. Por lo que es necesaria una conversi on

de se nal analogica a digital, esta transformacion la hace el conversor An alogo - Digital

(ADC). Una se nal de audio puede ser adquirida (ADC) y ltrada para: eliminar en gran

medida ruido, crujidos de estatica, amplicar ciertas frecuencias de interes, eliminar otras,

etc. Luego de esto, la informaci on puede ser devuelta a traves de una Conversion Digital

- Analoga (DAC) (gura 3.1).

24

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 25

Figura 3.1: Paso de se nal Anal ogica a Digital y Digital a Anal ogica

3.2. Digitalizaci on de la Se nal

3.2.1. Se nal Digital

Las se nales en tiempo discreto son aquellas que se representan matematicamente como

una secuencia de n umeros. Adem as de estar denidas en tiempo discreto, la amplitud de

la se nal puede ser tambien discreta. Entonces las se nales digitales son aquellas que son

discretas tanto en el tiempo como en la amplitud [SV05].

Una de las se nales m as importantes es la sinusoidal:

X

0

[n] = A

0

cos(W

0

n +

0

) (3.1)

En donde:

A

0

= Amplitud

W

0

= Frecuencia angular

0

= Angulo de fase

3.2.2. Muestreo

El proceso a traves del cual una se nal continua x (t) es transformada en una se nal dis-

creta equivalente x (k) consiste simplemente en la toma de muestras de la se nal continua en

instantes de tiempo discretos k denominados instantes de muestreo k = {..., 1, 0, 1, 2, 3, ...}.

En el caso de una grabacion digital de audio, a mayor cantidad de muestras tomadas, ma-

yor calidad y delidad tendr a la se nal digital resultante.

El proceso de muestreo se muestra en la gura 3.2. Para realizar dicho proceso es nece-

saria una se nal adicional que marque el ritmo de la toma de muestras, idealmente dicha

se nal p (t) es un tren de impulsos con una frecuencia f

s

= 1/T

s

denominada frecuencia de

muestreo (en hertzios). El muestreo puede ser uniforme ( T

s

constante) o no uniforme (T

s

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 26

variable), a T

s

se le llama tambien periodo de muestreo [JR05].

Figura 3.2: El Proceso de muestreo [JR05].

El teorema de Nyquist garantiza que para poder reconstruir una se nal a partir de sus

muestras, se debe utilizar una frecuencia f

s

2f

N

, o sea al menos el doble de f

N

. Siendo

f

N

la componente de m as alta frecuencia de la se nal [SV05].

Las tasas o frecuencias de muestreo m as utilizadas para audio digital son las siguientes:

16 000 muestras por segundo (16 kHz).

22 050 muestras por segundo (22.05 kHz).

24 000 muestras por segundo (24 kHz).

30 000 muestras por segundo (30 kHz).

44 100 muestras por segundo (44.1 kHz) (Calidad de CD de audio).

48 000 muestras por segundo (48 kHz).

Los humanos pueden percibir espectros de frecuencias que varan aproximadamente

desde 20 Hz a 20 kHz. Por esto, las se nales de audio se muestrean generalmente a 44100

Hz, o sea m as del doble de la m axima frecuencia audible.

Este es el caso del CD de audio.

El contenido en frecuencia de las se nales de voz puede abarcar hasta 15 khz o m as, pero la

voz es altamente inteligible incluso con bandas de frecuencia limitadas a unos 4 kHz. Ese

es el caso de los sistemas telefonicos comerciales donde la frecuencia de muestreo est andar

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 27

utilizada para la voz es de 8 kHz [SV05].

Durante el proceso de muestreo se asignan valores numericos equivalentes a la tensi on o

voltaje existente en diferentes puntos de la onda sinusoidal, con la nalidad de realizar

despues proceso de cuantizacion.

3.2.3. Cuantizaci on

Despues del muestreo, el siguiente paso es la cuantizacion de la muestra de entrada

(gura 3.3). Para esta parte del proceso los valores continuos de la se nal sinusoidal se con-

vierten en series de valores numericos decimales discretos correspondientes a los diferentes

niveles o variaciones de voltajes que contiene la se nal analogica muestreada.

Figura 3.3: Representacion conceptual del proceso de la digitalizacion de la se nal anal ogica

La precisi on de los datos dependera del n umero de bits con que se codiquen los niveles

de cuantizacion [WS99]. Por tanto, se introduce un ruido de cuantizaci on que se asume

como ruido blanco (gura 3.4).

En el presente trabajo hemos considerado una frecuencia de muestreo de 22.05 khz, y

para el proceso de cuantizaci on una longitud de la palabra de 16 bits.

3.3. Representaci on en el dominio de Frecuencias

En la gura 3.5 se puede apreciar la se nal en el dominio del tiempo, esta representacion

es considerada como onda compleja para el momento del analisis de la se nal. Por ello es

necesario transformarla al dominio de las frecuencias. Los sistemas lineales e invariantes

en el tiempo cumplen ciertas propiedades que hacen factible esta representaci on.

Un graco del dominio temporal muestra la evoluci on de una se nal en el tiempo,

mientras que un graco frecuencial muestra las componentes de la se nal seg un la frecuencia

en la que oscilan dentro de un rango determinado. Una representacion frecuencial incluye

tambien la informacion sobre el desplazamiento de fase que debe ser aplicado a cada

frecuencia para poder recombinar las componentes frecuenciales y poder recuperar de

nuevo la se nal original.

El dominio de la frecuencia est a relacionado con las series de Fourier, las cuales per-

miten descomponer una se nal peri odica en un n umero nito o innito de frecuencias.

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 28

Figura 3.4: Etapas de digitalizacion: Se nal original (izquierda), Se nal muestreada con

amplitudes analogicas (derecha), Se nal digital (abajo) [WS99].

3.3.1. Transformada Discreta de Fourier

La Transformada Discreta de Fourier (Discrete Fourier Transform, DFT) permite un

an alisis mas sencillo y ecaz sobre la frecuencia, sobre todo en aplicaciones de eliminaci on

de ruido y en otros tipos de ltrado (ltros pasa bajos, ltros pasa altos, ltros pasa

banda, ltros de rechazo de banda, etc.).

Dada una se nal en tiempo discreto X (n) con N muestras, su transformada X (k)

est a dada por la siguiente f ormula:

X(k) =

N1

n=0

X(n)e

j2nk

N

, k = 0, 1, ..., N 1 (3.2)

Y la Transformada Inversa de Fourier esta dada por:

X(n) =

1

N

N1

k=0

X(k)e

j2nk

N

, n = 0, 1, ..., N 1 (3.3)

Considerando la equivalencia:

e

j

= cos() +j sin() (3.4)

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 29

Figura 3.5: Gr aca en el dominio del tiempo (izquierda) y su correspondiente en frecuen-

cias (derecha)

El costo de la implementaci on de la DFT es cuadr atico O(n

2

), por ello en la practica

se reduce utilizando la Transformada R apida de Fourier (Fast Fourier Transform, FFT).

3.3.2. Transformada Rapida de Fourier (FFT)

El algoritmo FFT consiste en simplicar enormemente el c alculo del DFT introdu-

ciendo estrategias matematicas, reduciendo la complejidad al orden O(nlog(n)).

Partimos de la f ormula:

X(k) =

N1

n=0

X(n)W

kn

N

, k = 0, 1, ..., N 1 (3.5)

D onde: W

kn

N

= e

j2nk

N

, es llamado factor mariposa.

Considerando las siguientes simetras:

W

n+N

N

= W

n

N

(3.6)

W

NK

N

= 1

W

2

N

= W

N/2

W

n+N/2

N

= W

n

N

Existen muchos algoritmos r apidos de Fourier, pero para nuestro caso implementa-

remos el algoritmo Radix -2 FFT- Decimacion en el Tiempo, basado en el paradigma

divida y conquista[CG00] ( algoritmo 1).

Elegimos el valor N de la forma N = 2

m

, dividimos la secuencia de datos de entrada

x(n) en dos grupos, uno de ndices pares y el otro de ndices impares. Se aplica a cada

grupo el DFT de N/2 puntos y se combinan sus resultados para formar el DFT de N

puntos.

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 30

Algoritmo 1 Radix-2 FFT

Entrada: x [0...N 1]

Salida: X [0...N 1]

Si N = 1 Entonces

Devolver x [0]

Fin Si

Si Mod (N) = 2 Entonces

Devolver N no es potencia de 2

Fin Si

Para k = 0 hasta N/2 1 Hacer

Pares [k] x [2 k]

Fin Para

Para k = 0 hasta N/2 1 Hacer

Impares [k] x [2 k + 1]

Fin Para

Y

0...

N

2

1

Radix-2 FFT(Pares)

Z

0...

N

2

1

Radix-2 FFT(Impares)

Para k = 0 hasta N/2 1 Hacer

ang 2 k /N

W

k

cos (ang) +j sin (ang)

X [k] = Y [k] +W

k

Z [k]

X [k +N/2] = Y [k] W

k

Z [k]

Fin Para

Devolver X [0...N 1]

Resolviendo:

X(k) =

N

2

1

n=0

x(2n)W

2nk

N

+

N

2

1

n=0

x(2n + 1)W

(2n+1)k

N

(3.7)

X (k) =

N

2

1

n=0

x (2n) W

2nk

N

+W

k

N

N

2

1

n=0

x (2n + 1) W

2nk

N

(3.8)

Sustituyendo las simetras en la ecuaci on 3.8:

x

1

= x(2n)

x

2

= x(2n + 1)

W

2nk

N

= W

nk

N

2

Tenemos:

X (k) =

N

2

1

n=0

x

1

W

nk

N

2

+W

k

N

N

2

1

n=0

x

2

W

nk

N

2

(3.9)

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 31

X (k) = Y (k) +W

k

N

Z (k) , k = 0, 1, ..., N 1 (3.10)

Esta ultima ecuaci on muestra que el DFT de N puntos es la suma de dos DFTs de N/2

puntos: Y (k) y Z (k), realizadas con los grupos par e impar de la se nal original x (N).

Cada termino de Z (k) es multiplicado por un factor mariposa W

k

N

. (gura 3.6)

Figura 3.6: Esquema para una se nal de N=8 puntos [wikipedia].

Dado la simetra: W

k+N/2

N

= W

k

N

y debido a la propiedad de periodicidad de Y (k)

y Z (k) (periodo N/2) podemos decir que:

X (k) = Y (k) +W

k

N

Z (k) (3.11)

X

k +

N

2

= Y (k) W

k

N

Z (k)

k = 0, 1, ..., N/2 1

3.3.3. Enventanado

A partir de la transformada discreta de Fourier, se realiza un an alisis del contenido en

frecuencia de las se nales. Pero en la pr actica, para aplicaciones de audio, las propiedades

de la se nal no son estacionarias y una sola DFT no es suciente para describir el compor-

tamiento de esas se nales. La transformada de Fourier en tiempo corto (STFT) soluciona

este problema calculando la DFT a intervalos de la se nal. Este proceso se llama enven-

tanado [SV05]. El ventaneamiento consiste en aplicar sobre un bloque de la se nal x

N

(n)

una ventana w(n). Se aplica el solapamiento entre ventanas para mantener la continuidad

de informacion de la se nal (gura 3.7).

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 32

Figura 3.7: Solapamiento de ventanas

Cuanto mas r apidamente cambien las caractersticas de la se nal, m as corta deber a ser

la ventana para poder detectar esos cambios en el tiempo. Por otra parte, a medida que

decrece la longitud de la ventana, se reduce la resolucion frecuencial, es decir, la capacidad

de distinguir componentes cercanas en frecuencia. Adem as de la longitud se debe elegir

la forma de la ventana, o mas especcamente, el tipo de suavizado que se requiere en

los extremos de la misma [VW99]. En la tabla 3.1 se muestran tipos de ventanas m as

utilizadas, asimismo su representacion graca en la gura 3.8:

Ventana Formula

Rectangular w(n) =

1, 0 n < N

0, en otro caso

Hanning w(n) =

0,5 + 0,5 cos

2n

N

, 0 n < N

0, en otro caso

Hamming w(n) =

0,54 + 0,46 cos

2n

N

, 0 n < N

0, en otro caso

Bartlett w(n) =

2n

N

, 0 < n <

N

2

2

2n

N

,

N

2

< n < N

Cuadro 3.1: Tipos de Ventanas

Cada ventana tiene sus distintas propiedades y ser a ventajosa seg un la aplicaci on que

se trabaje, en la gura 3.9 se hace un an alisis del espectro de cada ventana en el dominio

de las frecuencias aplicando la FFT normalizada.

La ventana utilizada para nuestro caso es la ventana Hamming, ya que esta suaviza

la se nal en los extremos produciendo un menor derramamiento espectral en comparaci on

a las otras ventanas.

En la gura 3.10 vemos un ejemplo de aplicacion de la ventana Haming a una se nal.

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 33

3.3.4. Transformada Discreta del Coseno

A diferencia de la transformada de Fourier que utiliza senos y cosenos, la Transfor-

mada Discreta de Coseno (DTC) convierte a la se nales en componentes del coseno trigo-

nometrico, y la representacion de una se nal real mediante esta transformada, es tambien

real [VW99].

La Transformada discreta del coseno expresa una secuencia nita de varios puntos como

resultado de la suma de distintas se nales sinusoidales (con distintas frecuencias y ampli-

tudes).

Formalmente la transformada de coseno discreta es una funci on lineal e invertible del do-

minio real R

N

R

N

. Que tambien se puede entender de forma equivalente a una matriz

de N N posiciones.

Existen ocho variantes de la transformada, pero las m as usadas son la DCT-I (ecuacion

3.12) y la DCT-II (ecuacion 3.13):

X (k) =

1

2

x

0

+ (1)

k

x

N1

+

N2

n=1

x

n

cos

N 1

nk

, k = 0, ..., N 1 (3.12)

X (k) =

N1

n=0

x

n

cos

n +

1

2

, k = 0, ..., N 1 (3.13)

Existen modicaciones de la transformada para reducir la complejidad de procesamiento,

pero no es nuestro caso de estudio por lo que no van hacer necesarias implementarlas en

el proyecto. En la gura 3.11 se muestra las 4 maneras de representaci on de la DTC en 4

puntos.

3.3.5. Filtrado de la Se nal

Los ltros son una clase de sistemas lineales e invariantes con el tiempo particularmente

importante. Estrictamente hablando, el ltro selectivo en frecuencia sugiere un sistema

que deje pasar ciertas componentes de frecuencia y rechazar completamente otras. Pero en

un sentido m as amplio, cualquier sistema que modique ciertas frecuencias con respecto

a otras, tambien se denomina ltro [VW99].

De acuerdo con la parte del espectro que dejan pasar y que aten uan hay tres tipos de

ltros: Filtros paso alto, paso bajo y paso banda 3.12.

1. Filtro paso alto: aten uan las componentes de baja frecuencia pero no las de alta

frecuencia.

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 34

2. Filtro paso bajo: permitir el paso de las frecuencias m as bajas y atenuar las

frecuencias mas altas.

3. Filtro paso banda: deja pasar un determinado rango de frecuencias de una se nal

y aten ua el paso del resto.

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 35

Figura 3.8: Representacion gr aca de los tipos de Ventanas [wikipedia].

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 36

Figura 3.9: Espectro de las distintas ventanas [SV05]

Figura 3.10: Izquierda, la ventana Haming (azul) y la se nal original (rojo). Derecha, la

se nal resultante de la multiplicaci on [SV05]

Figura 3.11: Representacion de la DTC- I (a), DTC-II (b), DTC-III (c) y DTC-IV (d)

respectivamente [HAH01].

Captulo 3. PROCESAMIENTO DIGITAL DE SE

NALES DE AUDIO 37

Figura 3.12: Tipos de ltros [VW99]

Captulo 4

T

ECNICAS DE EXTRACCI

ON DE

CARACTER

ISTICAS

4.1. Resumen

Para lograr buenos resultados en la clasicaci on del audio es muy prioritario extraer

las caractersticas m as representativas de la se nal de audio, ya que de estos dependen los

optimos resultados en el c alculo del modelo de entrenamiento.

Es muy complicado determinar que caractersticas particulares nos servir an para distin-

guir los diferentes tipos de generos musicales; y m as aun considerando que los archivos

musicales contienen bastante informacion digital para procesar. De all que muchas in-

vestigaciones utilizan tecnicas como segmentaci on, compactacion y resumen de audio, lo

cual no es objetivo de estudio en nuestra investigaci on, pero sin embargo adecuaremos el

concepto de descriptores de audio a un muestreo extrado de la se nal en el dominio de las

frecuencias.

Estas tecnicas son estudiadas dentro del area de Reconocimiento de Patrones y en la ac-

tualidad existen muchas tecnicas de extraccion de caractersticas en audio, pero para nes

de este trabajo consideraremos 3 tecnicas que han demostrado obtener mejores resultados

de caracterizacion musical en la literatura estudiada: MFCC, las Caracterstica Especiales

en Tramas de Tiempo y el calculo del pitch.

4.2. Mel Frecuency Cepstral Coecients (MFCC)

Esta tecnica fue originalmente utilizada para el reconocimiento de voz, pero dado

a sus resultados signicativos en el an alisis tmbrica, tambien es utilizado dentro de la

clasicaci on de audio.

El MFCC Se basa en la extracci on de caractersticas perceptuales del audio, es decir

38

Captulo 4. T

ECNICAS DE EXTRACCI

ON DE CARACTER

ISTICAS 39

caractersticas que tengan en cuenta los aspectos m as humanos de la percepcion auditiva.

4.2.1. Cepstrum

Los coecientes cepstrales se obtienen del analisis del Cepstrum real. El Cepstrum es

la trasformaci on que nos va permitir separar la fuente de la excitaci on del ltro (glotis).

La excitaci on e (k) representa a la frecuencia fundamental que se produce en las cuerdas

vocales y el ltro h(k) representa las resonancia del tracto vocal producida por la variancia

en el diametro de la laringe, la posici on de la lengua, la mandbula, los dientes y los labios

(gura 4.1).

Figura 4.1: Representaci on del tracto vocal h(n) como un ltro lineal variable en el tiempo

Entonces la convulaci on est a dada por:

x (k) = e (k) h(k) (4.1)

Aplicando la Transformada de Fourier obtenemos:

X (k) = E (k) H (k) (4.2)

Esto debido a que la convulaci on de dos secuencias en el tiempo, implica su producto

en frecuencias [SV05].

Tomando el m odulo de X (k) al cuadrado obtenemos la DEP:

DEP (k) = |X (k)|

2

= |E (k)|

2

|H (k)|

2

(4.3)

Ahora el Cepstrum se dene como la Transformada Inversa de Fourier (IFT) del

logaritmo de la DEP:

C (k) = IFT (log (DEP)) (4.4)

Reemplazando DEP:

C (k) = IFT

log

|E (k)|

2

|H (k)|

2

= IFT (2 log (|E (k)|)) +IFT (2 log (|H (k)|))

(4.5)

Este resultado conrma que el cepstrum de una se nal esta dado por la suma del cepstrum

Captulo 4. T

ECNICAS DE EXTRACCI

ON DE CARACTER

ISTICAS 40

de la excitaci on y el de la transferencia del tracto vocal.

Para calcular los coecientes cepstrales de frecuencia Mel se aplica una variante: El Lo-

garitmo no se aplica directamente al DEP sino a los coecientes Mel (CVM), tambien se

utiliza la Transformada Discreta de Coseno (DCT) en lugar de IFT. La aplicacion de la

DCT enfatiza los coecientes cepstrales bajos:

C (k) = DCT (log (CV M)) (4.6)

Entendiendo esto procedemos a calcular los coecientes MFCC.

4.2.2. Calculo de los Coecientes Mel

Nos basaremos en el estandar ETSI ES 201 108 [ETSI00]. Para representar la voz se

suele utilizar 13 coecientes cepstrales y 1 coeciente del logaritmo de la energa, aunque

se ha demostrado que para el proceso de clasicacion de audio es suciente los 5 primeros

[TC02], nosotros decidimos trabajar con los 13 descriptores. Los pasos para calcular los

coecientes mel se aprecian en la gura 4.2:

Figura 4.2: Diagrama de bloques del algoritmo de front-end seg un el estandar ETSI ES

201 108 [ETSI00]

1. Compensacion del Oset

Se aplica este ltro para eliminar la componente DC de la se nal muestreada de la

anal ogica a digital X

m

.

X

CO

= X

m

(k) X

m

(k 1) + 0,999 X

CO

(K 1) (4.7)

Captulo 4. T

ECNICAS DE EXTRACCI

ON DE CARACTER

ISTICAS 41

2. Entramado (Frame)

Para considerar la se nal estacionaria, es necesaria procesarla en tramas de corta

duraci on. Para nuestro ejemplo hemos tomado un periodo de trama de 32 ms. Con

una solapamiento de 10 ms.

Para hallar el tama no del bloque correspondiente a esta trama, se obtiene en pro-

porcion a la maxima frecuencia. En nuestro caso para f

s

= 16000Hz obtendremos

una trama de tama no 512.

1s f

s

32ms N

N =

32ms f

s

1s

N =

32ms 16000hz

1000ms

= 512hz

A partir de aqu los siguientes pasos seran aplicado para cada trama.

En este trabajo utilizamos f

s

= 22050Hz y una ventana de 23 ms, originando una

trama de tama no 507, as que tuvimos que dimensionar a 512 completando con

ceros.

3. Filtro Pre-enfasis

Es un tipo de ltro paso alto, para que el espectro de la se nal tenga un aspecto mas

plano, dado que la se nal tiene un contenido m as signicativo en bajas frecuencias.

X

pe

(k) = X

CO

(k) 0,97 X

CO

(k 1) (4.8)

4. Ventana Hamming

En el captulo 2 se haba hecho el an alisis de las diferentes tipos de ventanas, esco-

giendo as la ventana de Haming para nuestra implementaci on ya que producen un

menor derramamiento espectral en la se nal resultante de la convulacion.

Formula de la ventana haming:

Hm(n) = 0,54 0,46 cos

2n

N

(4.9)

Aplicando 4.9 a la trama, obtenemos:

X

hm

(k) = Hm(k) X

pe

(k) , k = 0, 1, ..., N 1 (4.10)

Captulo 4. T

ECNICAS DE EXTRACCI

ON DE CARACTER

ISTICAS 42

5. Transformada Rapida de Fourier

La transformada de fourier al ser aplicado a solo una trama de la se nal toma el

nombre de Transformada de Fourier a Corto Plazo (STFT). Para el algoritmo que

aplicamos es necesario que el tama no de la trama (N) sea potencia de 2, sino lo es,

completar con ceros el vector hasta hacer coincidir su tama no en potencia de 2.

En nuestro caso la trama es de 23 ms lo que equivale a un bloque de 512 muestras.

X

ft

(k) =

N1

n=0

X

hm

(n) W

kn

N

, k = 0, 1, ..., N 1 (4.11)

6. Densidad Espectral de la Potencia (DEP)

El resultado de la transformada r apida de fourier son valores complejos y para

trabajarlos como reales es necesario calcular el modulo, obteniendo la DEP:

X

DEP

(k) = |X

ft

(k)|

2

(4.12)

Recordando que el m odulo de un n umero complejo es:

|a +jb| =

a

2

+b

2

(4.13)

Debido que la transformada retorna valores conjugados, hace que la se nal sea simetri-

ca, como se puede apreciar en la gura 3.5 . Por ello para cuestiones de simplicaci on

solo se trabaja con la mitad de la trama

7. Coecientes Mel (CVM)

Para hallar una aproximaci on del comportamiento de la percepcion del odo humano,

utilizamos la escala MEL (gura 4.3). Se forman tri angulos linealmente espaciales

en la escala Mel y sus correspondientes en Hertz. A estos tri angulos se le denomina

Bancos de Filtro Mel o simplemente Bins, que adem as est an solapados, es decir

las bases de cada tri angulo est a comprendida entre los frecuencias centrales de sus

tri angulos adyacentes [SV05].

En este ejemplo consideraremos 5 Bins y la escala en Hertz de 8000 (m axima fre-

cuencia en 16khz).

Para hallar la frecuencia en Hertz expresada en Mels, utilizamos la siguiente apro-

ximaci on:

Mel (f) = 2595 log

10

1 +

f

700

(4.14)

Y Para hallar la frecuencia en Mels expresada en Herts, aplicamos la inversa de la

Captulo 4. T

ECNICAS DE EXTRACCI

ON DE CARACTER

ISTICAS 43

Figura 4.3: Escala Mel con 5 Bins

formula anterior:

Mel

1

(m) = 700

10

m

2595

1

(4.15)

Para formar los valores de cada ltro triangular, se aplica la siguiente f ormula:

H

m

(k) =

0 , si k < f (m1)

k f (m1)

f (m) f (m1)

, si f (m1) k f (m)

f (m+ 1) k

f (m+ 1) f (m)

, si f (m) k f (m+ 1)

0 , si k > f (m+ 1)

(4.16)

En la gura 4.4 representamos gracamente la ecuacion parametrica 4.16 del ltro

triangular.

Figura 4.4: Filtro triangular con altura 1

Una observaci on importante a esta f ormula, es que genera triangulos en la escala de

0 a Fs/2 (Fs: frecuencia de muestreo). Mientras que el tama no de la trama es de 256.

Por lo tanto antes de calcular los valores del tri angulo debemos escalar f (m1),

Captulo 4. T

ECNICAS DE EXTRACCI

ON DE CARACTER

ISTICAS 44

f (m) y f (m+ 1) al tama no de la trama, seg un la ecuacion 4.17:

Suponiendo que Fs es 16 KHz, entonces Fs/2 = 8000 Hz.

256 8000

f

(m) f (m)

(m) =

f (m) 256

8000

El resultado que se obtiene seria K Bins:

Bin(k) =

|H

m

|

i

H

m

(k, i) X

DEP

(k) +i

, k = 0, ..., K 1 (4.17)

8. Transformada no Lineal (Logaritmo)

Antes de aplicar la DTC debemos calcular el logaritmo neperiano de cada Bin:

Y (k) = ln (Bin(k)) (4.18)

9. Transformada Discreta del Coseno II (DTC II)

Y como se haba visto en la formula del Cepstrum, debemos aplicar la DTC a los

CVM:

Y

DTC

(k) =

N

i1

Y (k) cos

k

N

(i 0,5)

en donde N = 5 (4.19)

4.3. Caractersticas en Tramas de Tiempo Especiali-

zadas

Los par ametros utilizados en las fuentes consultadas como ya habamos mencionado

son clasicados en 3 tipos: par ametros relacionados al timbre, al ritmo y al pitch de la

se nal. Los descriptores usados para representar la textura tmbrica son usados mayormente

en la discriminaci on voz/m usica, pero tambien han demostrado muy buenos resultados

en clasicacion por genero musical [TC02].

Considerando que: N = longitud de la trama y X

ft

= Transformada de Fourier aplicada

a la trama respectiva.

1. Spectral Centroid

Captulo 4. T

ECNICAS DE EXTRACCI

ON DE CARACTER

ISTICAS 45

Es denido como el centro de la gravedad del espectro de la magnitud, es decir

la frecuencia que divide el espectro en dos proporciones iguales. Este par ametro

est a relacionado con la Brillantes del Sonido, por ello un constituyente importante

de la percepci on del timbre.

X

SCent

=

N

k=1

X

ft

(k) k

N

k=1

X

ft

(k)

(4.20)

2. Spectral Rollo

Se dene como la frecuencia por debajo de la cual se concentra el PR% de la

magnitud del espectro. Se considera un valor tpico de PR = 0,85. Este par ametro

nos da una idea de la forma del espectro:

X

SRoll

k=1

|X

ft

(k)| = PR

N

k=1

|X

ft

(k)| (4.21)

3. Spectral Flux

Se dene como el cuadrado de la diferencia entre las magnitudes del espectro de dos

tramas consecutivas. Se trata de una medida de la cantidad de cambios locales:

X

SFlux

=

N

k=1

(X

ft

(k) X

ft1

(k))

2

(4.22)

X

ft1

(k) es la FFT de la trama anterior.

4. STE(Short-TimeEnergy)

C alculo de la medida de la energa, que corresponde a la potencia cuadratica de la

se nal temporal:

X

STE

=

1

N

N

k=1

X

CO

(k)

2

(4.23)

X

CO

es la Compensaci on del Oset a la se nal (visto en el c alculo del MFCC).

5. LGSTE - Medida de la Energia

Es el logaritmo (en base 10 o e) de STE:

X

LGSTE

= log (X

STE

N) (4.24)

6. ZCR (Zero CrossingRate)

Se dene como la tasa de cruces por Cero. Este par ametro nos da la idea de que tan

ruidosa es la se nal. Aunque de manera estricta no es un par ametro relacionado con

Captulo 4. T

ECNICAS DE EXTRACCI

ON DE CARACTER

ISTICAS 46

el timbre, sino con el tiempo. Este par ametro es de gran interes para el problema

de la discriminacion de voz/m usica.

X

ZCR

=

1

2

N

k=1

|sign(x (k)) sign(x (k 1))| (4.25)

x (k) es la se nal temporal, en el dominio del tiempo.

4.4. Calculo del Pitch

La determinacion del periodo de pitch o tambien denominado frecuencia fundamental

es de importancia en el procesamiento de se nales de voz debido a que es utilizada para

realizar tareas de sntesis de habla, reconocimiento automatico de habla, reconocimiento

de lenguajes tonales, vericaci on del locutor, entre otras [SLEH06].

El pitch de un sonido simple (el cual contiene una unica componente en frecuencias),

es una variable que nos indica si el sonido es alto o bajo, por ello nos indicara la locali-

zaci on del sonido dentro de una escala musical. Para el calculo del valor del perodo de

pitch en una se nal de habla se han desarrollado gran cantidad de algoritmos los cuales

se basan principalmente en tres metodologas: metodo de correlaci on (dominio temporal),

metodo HPS - Harmonic Product Spectrum (dominio frecuencial) y usando la transfor-

mada wavelet (dominio conjunto).

El algoritmo que emplearemos se basa en el metodo de correlaci on que trabaja en el

dominio del tiempo. Especcamente el algoritmo que proponemos se basa en el propuesto

por [DRR67] y [DB96] para la determinaci on del pitch. Las caractersticas referentes a la

obtenci on del Pitch son:

En una onda ac ustica, los picos m aximos de una determinada localidad son llamados

picos maximos signicativos o maximos locales y tienen una amplitud mayor o igual

que el 90 % de un maximo signicativo de una localidad aleda na..

Los mnimos signicativos de una onda representan los picos mnimos de una onda

y se localiza dentro de 2.5ms de la localidad de un m aximo signicativo.

No existen pitch relevantes menores a 2ms o mayores a 14ms.

Lo periodos entre pitch son bastantes similares, por lo que son considerados como

un rango de b usqueda.

Captulo 4. T

ECNICAS DE EXTRACCI

ON DE CARACTER

ISTICAS 47

4.4.1. Esquema del Algoritmo

A continuacion se presentara el algoritmo 2 en el que se muestran los pasos para seguir

para la determinacion del periodo de pitch:

Es recomendable que el vector de audio que ingresa como parametro del algoritmo haya

sido previamente procesado por un algoritmo de Eliminaci on De Segmentos In utiles, para

trabajar solamente sobre la se nal con informaci on relevante, este algoritmo se implementa

al momento de digitalizar la se nal eliminando los silencios y el ruido.

Algoritmo 2 Determinaci on del Pitch

Entrada: V S: vector de la se nal de habla sin segmentos in utiles

V filtro: vector de ltro de medias

Salida: ppitch: valor que indica la frecuencia fundamental

1: maxsenial getIndexMaxPico(V S)

2: Xp cubeClip(V S)

3: umbral 0,4 Xp[maxsenial]

4: Xc tClip(Xp, umbral)

5: Xsuave convolucionar(Xc, V filtro)

6: Xmlo getMaximosLocales(Xsuave)

7: Xdist getDistMaximos(Xmlo)

8: media getMedia(Xdist)

9: desv getDesviacionEstandar(Xdist, media)

10: Xcheck checkDist(Xdist, media, desv)

11: Xrecheck reCheckDist(Xdist, Xcheck, media)

12: ppitch getMedia(Xrecheck)

13: Devolver ppitch

En el paso 1 obtenemos con la funcion getIndexMaxPico() el ndice del pico m as

alto del vector V S que le enviamos como par ametro de dicha funci on.

En el paso 2 enviamos al vector V S como parametro de la funci on cubeClip(), la

misma que tomar a cada elemento de dicho vector, lo duplicar a y a ese resultado lo

elevara al cubo, devolviendo un nuevo vector Xp almacenando los nuevos valores

del resultado de este computo.

En el paso 3 obtenemos el umbral que es el valor del producto de la constante 0,4

por el valor del pico mas alto del vector Xp obtenido en el paso 2.

En el paso 4 enviamos Xp y umbral como par ametros de la funcion tClip() la cual

se encargara de eliminar aquellos elementos de Xp cuyo valor absoluto sea menor o

igual que el valor de umbral, en caso contrario almacenar a en un nuevo vector Xc

el resultado de la diferencia entre el valor absoluto de dicho elemento y umbral.

Captulo 4. T

ECNICAS DE EXTRACCI

ON DE CARACTER

ISTICAS 48

Estos 4 primeros pasos son llevados a cabo con el objetivo de eliminar aquellas

se nales de la onda que esten por debajo de un umbral, el cual en este caso es

considerado como debajo de la mitad del pico m as alto de toda la onda.

En el paso 5 debemos de suavizar el vector Xc obtenido en el paso 4, convolu-

cion andolo mediante un vector de ltro de suavizado de media y almacenando el

resultado en el vector Xsuave. El vector de ltro de media que se uso es de longitud

7 y mantiene los elementos: 0.05, 0.1, 0.2, 0.3, 0.2, 0.1, 0.05 en el respectivo orden

en el que se presentan seg un la propuesta en [DB96] .

Lo siguiente es encontrar los m aximos locales, los cuales seg un [DRR67] deben cum-

plir con la caracterstica de tener una amplitud mayor o igual que el 90 % de un

m aximo signicativo de una localidad aleda na, esto lo realizamos en el paso 6 me-

diante la funcion getMaximosLocales() la cual recibe como par ametro de entrada

el vector suavizado Xsuave y devuelve el vector Xmlo conteniendo los maximos

locales.

Ahora necesitamos saber que tan cercanos se encuentran los m aximos locales que

son vecinos, por eso, el siguiente paso es calcular la distancia entre cada par sucesivo

de los m aximos locales enviando en el paso 7 al vector Xmlo como parametro de

entrada de la funci on getDistMaximos() la cual almacenar a en el vector Xdist la

diferencia entre los elementos Xmlo[i + 1] y Xmlo[i].

Lo siguiente es conocer aquellos m aximos locales que son vecinos, para esto lo que

debemos hacer es eliminar las se nales cuyo valor absoluto de la diferencia entre los

elementos del vector Xdist y la media de dicho vector sea mayor que su desviacion

est andar (con la funci on checkDist() del paso 10). Es por eso que en los pasos 8 y

9 calculamos respectivamente la media del vector Xdist y su desviaci on estandar.

Nuevamente debemos recalcular las distancias entre los picos maximos locales de

la onda con respecto a aquellos que han sido eliminados en los pasos anteriores.