Unidad 4

Diunggah oleh

Veronica KuJudul Asli

Hak Cipta

Format Tersedia

Bagikan dokumen Ini

Apakah menurut Anda dokumen ini bermanfaat?

Apakah konten ini tidak pantas?

Laporkan Dokumen IniHak Cipta:

Format Tersedia

Unidad 4

Diunggah oleh

Veronica KuHak Cipta:

Format Tersedia

4.

1 INTRODUCCIN Una cadena de Markov, que recibe su nombre del matemtico ruso Andrei Markov, es una serie de eventos, en la cual la probabilidad de que ocurra un evento depende del evento inmediato anterior. En efecto, las cadenas de este tipo tienen memoria. Recuerdan el ltimo evento y esto condiciona las posibilidades de los eventos futuros. Esta dependencia del evento anterior distingue a las cadenas de Markov de las series de eventos independientes, como tirar una moneda al aire o un dado. En los negocios, las cadenas de Markov se han utilizado para analizar los patrones de compra de los deudores morosos, para planear las necesidades de personal y para analizar el reemplazo de equipo. En matemticas, se define como un proceso estocstico discreto que cumple con la Propiedad de Markov, es decir, si se conoce la historia del sistema hasta su instante actual, su estado presente resume toda la informacin relevante para describir en probabilidad su estado futuro. Una cadena de Markov es una secuencia X1, X2, X3, de variables aleatorias. El rango de estas variables, es llamado espacio estado, el valor de Xn es el estado del proceso en el tiempo n. Si la distribucin de probabilidad condicional de Xn+1 en estados pasados es una funcin de Xn por s sola, entonces: Donde xi es el estado del proceso en el instante i. La identidad mostrada es la Propiedad de Markov. Una cadena de Markov es una serie de eventos, en la cual la probabilidad de que ocurra un evento depende del evento inmediato anterior. En efecto, las cadenas de este tipo tienen memoria. Recuerdan el ltimo evento y esto condiciona las posibilidades de los eventos futuros. Esta dependencia del evento anterior distingue a las cadenas de Markov de las series de eventos independientes, como tirar una moneda al aire o un dado. En los negocios, las cadenas de Markov se han utilizado para analizar los patrones de compra de los deudores morosos, para planear las necesidades de personal y para analizar el reemplazo de equipo.

El anlisis de Markov, llamado as en honor de un matemtico ruso que desarrollo el mtodo en 1907, permite encontrar la probabilidad de que un sistema se encuentre en un estado en particular en un momento dado. Algo ms importante an, es que permite encontrar el promedio a la larga o las probabilidades de estado estable para cada estado. Con esta informacin se puede predecir el comportamiento del sistema a travs del tiempo. La tarea ms difcil es reconocer cundo puede aplicarse. La caracteristica ms importante que hay que buscar en la memoria de un evento a otro. Formulacin de las cadenas de Markov. Una cadena de Markov es una serie de eventos, en la cual la probabilidad de que ocurra un evento depende del evento inmediato anterior. En efecto, las cadenas de este tipo tienen memoria. Recuerdan el ltimo evento y esto condiciona las posibilidades de los eventos futuros. Esta dependencia del evento anterior distingue a las cadenas de Markov de las series de eventos independientes, como tirar una moneda al aire o un dado. En la figura 4.1.1 se muestra el proceso para formular una cadena de Markov. El generador de Markov produce uno de n eventos posibles, Ej , donde j = 1, 2, . . . , n, a intervalos discretos de tiempo (que no tiene que ser iguales ). Las probabilidades de ocurrencia para cada uno de estos eventos depende del estado del generador. Este estado se describe por el ltimo evento generado. En la figura 4.1.1, el ltimo evento generado fue Ej , de manera que el generador se encuentra en el estado Mj . La probabilidad de que Ek sea el siguiente evento generado es una probabilidad condicional : P ( Ek / Mj ). Esto se llama probabilidad de transicin del estado Mj al estado Ek. Para describir completamente una cadena de Markov es necesario saber el estado actual y todas las probabilidades de transicin. Probabilidades de transicin. Una forma de describir una cadena de Markov es con un diagrama de estados, como el que se muestra en la figura 4.1.2. En sta se ilustra un sistema de Markov con cuatro estados posibles : M1, M2 , M3 y M4 . La probabilidad condicional o de transicin de moverse de un estado a otro se indica en el diagrama

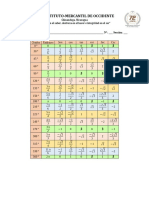

Otro mtodo para exhibir las probabilidades de transicin es usar una matriz de transicin. . La matriz de transicin para el ejemplo del diagrama de estados se muestra en la tabla 4.1.1 . Otro mtodo para exhibir las probabilidades de transicin es usar una matriz de transicin. . Para n = 0, 1, 2, . El superndice n no se escribe cuando n = 1. Procesos estocsticos. Un proceso estocstico se define sencillamente como una coleccin indexada de variables aleatorias { X1 }, donde el subndice t toma valores de un conjunto T dado. Con frecuencia T se toma como el conjunto de enteros no negativos y X, representa una caracterstica de inters medible en el tiempo t. Por ejemplo, el proceso estocstico, X1 , X2 , X3, .., Puede representar la coleccin de niveles de inventario semanales (o mensuales) de un producto dado, o puede representar la coleccin de demandas semanales (o mensuales) de este producto. Un estudio del comportamiento de un sistema de operacin durante algn periodo suele llevar al anlisis de un proceso estocstico con la siguiente estructura. En puntos especficos del tiempo t , el sistema se encuentra exactamente en una de un nmero finito de estados mutuamente excluyentes y exhaustivos, etiquetados 0, 1, . . , S. Los periodos en el tiempo pueden encontrarse a intervalos iguales o su esparcimiento puede depender del comportamiento general del sistema en el que se encuentra sumergido el proceso estocstico. Aunque los estados pueden constituir una caracterizacin tanto cualitativa como cuantitativa del sistema, no hay prdida de generalidad con las etiquetas numricas 0, 1, . . , M , que se usarn en adelante para denotar los estados posibles del sistema. As la representacin matemtica del sistema fsico es la de un proceso estocstico {Xi}, en donde las variables aleatorias se observan en t = 0, 1, 2,. . ., y en donde cada variable aleatoria puede tomar el valor de cualquiera de los M + 1 enteros 0, 1, .. , M . Estos enteros son una caracterizacin de los M + 1 estados del proceso. Propiedad Markoviana de 1o. orden . Se dice que un proceso estocstico tiene la propiedad markoviana si

P Xt+1 = j = P X t+1 , para toda t = 0, 1, . . y toda sucesin i, j , K0 , K1 , . . , Ki-1 . Se puede demostrar que esta propiedad markoviana es equivalente a establecer una probabilidad condicional de cualquier evento futuro dados cualquier evento pasado y el estado actual Xi = i , es independiente del evento pasado y slo depende del estado actual del proceso. Las probabilidades condicionales PXt+1 = j se llaman probabilidades de transicin. Si para cada i y j, P Xt+1 = j = pX1 = j , para toda t = 0, 1, . Entonces se dice que las probabilidades de transicin (de un paso) son estacionarias y por lo general se denotan por pij . As, tener probabilidades de transicin estacionarias implican que las probabilidades de transicin no cambian con el tiempo. La existencia de probabilidades de transicin (de un paso) estacionarias tambin implica que, para cada i, j y n (n = 0, 1, 2,), P Xt+n = j = pXn = j , Para toda t = 0, 1, . . . Estas probabilidades condicionales casi siempre se denotan por y se llaman probabilidades de transicin de n pasos. As, es simplemente la probabilidad condicional de que la variable aleatoria X, comenzando en el estado i, se encuentre en el estado j despus de n pasos ( unidades de tiempo ). Como las son probabilidades condicionales, deben satisfacer las propiedades: Probabilidad de transicin de un solo paso. Ejemplo : Una tienda de cmaras tiene en almacn un modelo especial de cmara que se puede ordenar cada semana. Sean D1, D2, las demandas de esta cmara durante la primera, segunda, , semana, respectivamente. Se supone que las Di son variables aleatorias independientes e idnticamente distribuidas que tienen una distribucin de probabilidad conocida. Sea X0 el nmero de cmaras que se tiene en el momento de iniciar el proceso, X1 el nmero de cmaras que se tienen al final de la semana uno, X2 el nmero de cmaras al final de la semana dos, etc. Suponga que X0 = 3 . El sbado en la noche la tienda hace un pedido que le

entregan el lunes en el momento de abrir la tienda. La tienda hace un pedido que le entregan el lunes en el momento de abrir la tienda. La tienda usa la siguiente poltica ( s, S)1 para ordenar : si el nmero de cmaras en inventario al final de la semana es menor que s =1 (no hay cmaras en la tienda), ordenar (hasta) S=3. De otra manera, no coloca la orden (si se cuenta con una o ms cmaras en el almacn, no se hace el pedido). Se supone que las ventas se pierden cuando la demanda excede el inventario. Entonces, {X1} para t = 0, 1, .. es un proceso estocstico de la forma que se acaba de describir. Los estados posibles del proceso son los enteros 0, 1, 2, 3 que representan el nmero posible de cmaras en inventario al final de la semana. Observe que {Xi}, en donde Xi es el nmero de cmaras en el almacn al final de la semana t ( antes de recibir el pedido }), es una cadena de Markov. Se ver ahora cmo obtener las probabilidades de transicin (de un paso), es decir, los elementos de la matriz de transicin ( de un paso). Suponiendo que cada Dt tiene una distribucin Poisson con parmetro . Para obtener es necesario evaluar . Si , Entonces . Por lo tanto, significa que la demanda durante la semana fue de tres o ms cmaras. As, , la probabilidad de que una variable aleatoria Poisson con parmetro tome el valor de 3 o ms; y se puede obtener de una manera parecida. Si , entonces . Para obtener , la demanda durante la semana debe ser 1 o ms. Por esto, . Para encontrar , observe que si . En consecuencia, si , entonces la demanda durante la semana tiene que ser exactamente 1. por ende, . Los elementos restantes se obtienen en forma similar, lo que lleva a la siguiente a la siguiente matriz de transicin ( de un paso): Probabilidad de transicin estacionaria de n pasos. Las ecuaciones de Chapman-Kolmogorov proporcionan un mtodo para calcular estas probabilidades de transicin de n pasos : Estas ecuaciones simplemente sealan que al ir de un estado i al estado j en n pasos, el proceso estar en algn estado k despus de exactamente m ( menor que n) pasos. As, Es solo las probabilidad condicional de que, si se comienza en el estado i, el proceso vaya al estado k despues de m pasos y despus al estado j en n- m pasos.

Los casos especiales de m=1 y m=n-1 conducen a las expresiones Para toda i, j, y n de lo cual resulta que las probabilidades de transicin de n pasos se pueden obtener a partir de las probabilidades de transicin de un paso de manera recursiva. Para n=2, estas expresiones se vuelven : Note que las son los elementos de la matriz P(2) , pero tambin debe de observarse que estos elementos, se obtienen multiplicando la matriz de transicin de un paso por s misma; esto es , P(2) = P * P = P2 . En trminos ms generales, se concluye que la matriz de probabilidades de transicin de n pasos se puede obtener de la expresin : P(n) = P * P . P = Pn = PPn1 = Pn-1 P. Entonces, la matriz de probabilidades de transicin de n pasos se puede obtener calculando la n-sima potencia de la matriz de transicin de un paso. Para valores no muy grandes de n, la matriz de transicin de n pasos se puede calcular en la forma que se acaba de describir, pero cuando n es grande, tales clculos resultan tediosos y, ms an, los errores de redondeo pueden causar inexactitudes. Ejemplo : Una tienda de cmaras tiene en almacn un modelo especial de cmara que se puede ordenar cada semana. Sean D1, D2, las demandas de esta cmara durante la primera, segunda, , semana, respectivamente. Se supone que las Di son variables aleatorias independientes e idnticamente distribuidas que tienen una distribucin de probabilidad conocida. Sea X0 el nmero de cmaras que se tiene en el momento de iniciar el proceso, X1 el nmero de cmaras que se tienen al final de la semana uno, X2 el nmero de cmaras al final de la semana dos, etc. Suponga que X0 = 3 . El sbado en la noche la tienda hace un pedido que le entregan el lunes en el momento de abrir la tienda. La tienda hace un pedido que le entregan el lunes en el momento de abrir la tienda. La tienda usa la siguiente poltica ( s, S)1 para ordenar : si el nmero de cmaras en inventario al final de la semana es menor que s =1 (no hay cmaras en la tienda), ordenar (hasta) S=3. De otra manera, no coloca la orden (si se cuenta con una o ms cmaras en el almacn, no se hace el pedido). Se supone que las ventas se pierden cuando la demanda excede el inventario. Entonces, {X1} para t = 0, 1, .. es un proceso estocstico de la forma que se acaba de describir. Los estados posibles del

proceso son los enteros 0, 1, 2, 3 que representan el nmero posible de cmaras en inventario al final de la semana. As, dado que tiene una cmara al final de una semana, la probabilidad de que no haya cmaras en inventario dos semanas despus es 0.283; es decir, De igual manera, dado que se tienen dos cmaras al final de una semana, la probabilidad de que haya tres cmaras en el almacn dos semanas despus es 0.097; esto es, La matriz de transicin de cuatro pasos tambin se puede obtener de la siguiente manera : P(4) = P4 = P(2) * P(2) As, dado que queda una cmara al final de una semana, 0.282 es la probabilidad de que no haya cmaras en inventario 4 semanas ms tarde; es decir, De igual manera, dado que quedan dos cmaras en el almacn final de una semana, se tiene una probabilidad de 0.171 de que haya tres cmaras en el almacn 4 semanas despus; esto es, Probabilidades de transicin estacionaria de estados estables. Teorema Sea P la matriz de transicin de una cadena de M estados . Existe entonces un vector tal que Se establece que para cualquier estado inicial i , . El vector a menudo se llama distribucin de estado estable, o tambin distribucin de equilibrio para la cadena de Markov. Para encontrar la distribucin de probabilidades de estacionario para una cadena dada cuya matriz de transicin es P, segn el teorema, para n grande y para toda i , (1) Como Pij (n + 1) = ( rengln i de Pn )(columna j de P), podemos escribir (2) Ejemplo :

Suponga que toda la industria de refrescos produce dos colas. Cuando una persona ha comprado la cola 1, hay una probabilidad de 90 % de que su siguiente compra se de cola 1. Si una persona compr cola 2, hay un 80 % de probabilidades que su prxima compra sea de cola 2. Entonces : Al reemplazar la segunda ecuacin por la condicin , obtenemos el sistema Al despejar resulta que Por lo tanto, despus de largo tiempo, hay probabilidad 2/3 de que una persona dada compre cola 1 y 1/3 de probabilidad de que una persona compre cola 2. Tiempos de primer paso. Con frecuencia es conveniente poder hacer afirmaciones en trminos de probabilidades sobre el nmero de transiciones que hace el proceso al ir de un estado i a un estado j por primera vez . este lapso se llama tiempos de primer paso al ir del estado i al estado j. cuando J=i, esta tiempo de primer paso es justo el nmero de transiciones hasta que el proceso regresa al estado inicial i. En este caso, el tiempo de primer paso se llama tiempo de recurrencia para el estado i. Para ilustrar estas definiciones, reconsidrese el ejemplo siguiente : Una tienda de cmaras tiene en almacn un modelo especial de cmara que se puede ordenar cada semana. Sean D1, D2, las demandas de esta cmara durante la primera, segunda, , semana, respectivamente. Se supone que las Di son variables aleatorias independientes e idnticamente distribuidas que tienen una distribucin de probabilidad conocida. Sea X0 el nmero de cmaras que se tiene en el momento de iniciar el proceso, X1 el nmero de cmaras que se tienen al final de la semana uno, X2 el nmero de cmaras al final de la semana dos, etc. Suponga que X0 = 3 . El sbado en la noche la tienda hace un pedido que le entregan el lunes en el momento de abrir la tienda. La tienda hace un pedido que le entregan el lunes en el momento de abrir la tienda. La tienda usa la siguiente poltica ( s, S)1 para ordenar : si el nmero de cmaras en inventario al final de la semana es menor que s =1 (no hay cmaras en la tienda), ordenar (hasta) S=3. De otra manera, no coloca la orden (si se cuenta con una o ms cmaras en el

almacn, no se hace el pedido). Se supone que las ventas se pierden cuando la demanda excede el inventario. Entonces, {X1} para t = 0, 1, .. es un proceso estocstico de la forma que se acaba de describir. Los estados posibles del proceso son los enteros 0, 1, 2, 3 que representan el nmero posible de cmaras en inventario al final de la semana. Donde Xt es el nmero de cmaras en inventario al final de la semana t y se comienza con , Suponga que ocurri lo siguiente: En este caso, el tiempo de primer paso para ir al estado 3 al estado 1 es dde 2 semanas, el tiempo de primer paso para ir del estado 3 al estado 0 es de 3 semanas y el tiempo de recurrencia del estado 3 es de 4 semanas. En general, los tiempos de primer paso son variables aleatorias y, por lo tanto, tienen una distribucin de probabilidad asociada a ellos. Estas distribuciones de probabilidad dependen de las probabilidades de transicin del proceso. En particular, denota la probabilidad de que el tiempo de primer paso del estado i al j sea igual a n. Se puede demostrar que estas probabilidades satisfacen las siguientes relaciones recursivas: Entonces se puede calcular la probabilidad de un tiempo de primer paso del estado i al j en n pasos, de manera recursiva, a partir de las probabilidades de transicin de un paso. En el ejemplo, la distribucin de probabilidad de los tiempos de primer paso del estado 3 al estado 0 se obtiene como sigue: Para i y j fijos, las son nmeros no negativos tales que Esta suma puede ser menor que 1, lo que significa que un proceso que el iniciar se encuentra en el estado i puede no llegar nunca al estado j . Cuando la suma es igual a 1, las pueden considerarse como una distribucin de probabilidad para la variable aleatoria, el tiempo de primer paso. Para obtener el tiempo esperado de primer paso del estado i al estado j. Sea , que se define como: entonces satisface, de manera nica, la ecuacin: Cuando i=j, se llama tiempo esperado de recurrencia.

Al aplicarlo al ejemplo del inventario, estas ecuaciones se pueden usar para calcular el tiempo esperado hasta que ya no se tengan cmaras en el almacn, suponiendo que el proceso inicia cuando se tienen tres cmaras; es decir, se puede obtener el tiempo esperado de primer paso . Como todos los estados son recurrentes, el sistema de ecuaciones conduce a las expresiones La solucin simultnea de este sistema es De manera que el tiempo esperado hasta que la tienda se queda sin cmaras es de 3.50 semanas. Caso de Aplicacin. Aplicacin a la administracin : Planeacin de Personal. El anlis de transicin puede ser til al planear satisfacer las necesidades de personal. Muchas firmas emplean trabajadores de diferentes niveles de clasificacin dentro de la misma categora de trabajo. Esto es comn para personal de confianza, oficinistas, obreros calificados, no calificados y personal profesional. La firma debe tener el nmero de empleados en cada nivel de clasificacin para proporcionar la oportunidad de promocin adecuada, cumplir con las habilidades necesarias para el trabajo y controlar la nmina. Una planeacin de personal a largo plazo apropiada requiere que se considere el movimiento de personas tanto hacia arriba en el escalafn de clasificacin como hacia afuera de la organizacin. El anlisis de Markov puede ayudar en este esfuerzo de planeacin. El movimiento de personal a otras clasificaciones puede considerarse como una cadena de Markov. Se supone que hay tres clasificaciones; el grado 1 es la ms baja. Adems, los descensos se consideran raros y se omiten. El estado salen es absorbente, el cual incluye renuncias, ceses, despidos y muertes. Por supuesto, todos los empleados finalmente alcanzan este estado. Las transiciones del grado 1 al grado 2 y del grado 2 al grado 3 representan promociones. Como transiciones de probabilidad, estn controladas por la firma, puede establecerse el nivel que la firma determine que es necesario para cumplir sus objetivos. Como ejemplo, supngase que la firma tiene en este momento 30 empleados del 3, 90 empleados del grado 2 y 300 empleados del grado 1 y que desea mantener este nivel de empleados durante el prximo ao. Por experiencia,

se espera que salgan el 30 % de los empleados de grado 1 al ao, el 20 % de los empleados de grado 2 y el 10 % de aquellos que estn en el grado 3. Si la poltica es contratar slo en los niveles de clasificacin ms bajos, cuntos se deben contratar y cuntos se deben promover el siguiente ao para mantener estables los niveles ?. Este problema puede resolverse sin el anlisis de Markov, pero el modelo es til para ayudar a conceptualizar el problema. Como se trata slo de un ciclo, se usa el anlisis de transicin. El anlisis comienza con el graado ms alto. No se hacen promociones pero el 10 %, o sea, 3, sale. Todos ellos deben de reemplazarse por promociones del grado 2. En el nivel de clasificacin, el 20 % sale y se deben promover 3, con una prdida de 21. Esto se debe compensar por promocin del grado 1. Al pasar al grado 1, el 30 % sale y 21 deben promoverse, lo cual una prdida total de 111. Por tanto, el siguiente ao se deben contratar 111 empleados del nivel 1. En este ejemplo se derivan algunas tasas de transicin a partir de consideraciones externas. http://www.mitecnologico.com/Main/CadenasDeMarkovIntroduccion 4.2 FORMULACIN DE LAS CADENAS MARKOV CONCEPTO DE UNA CADENAS DE MARKOV Una cadena de Markov es una serie de eventos, en la cual la probabilidad de que ocurra un evento depende del evento inmediato anterior. En efecto, las cadenas de este tipo tienen memoria. Recuerdan el ltimo evento y esto condiciona las posibilidades de los eventos futuros. Esta dependencia del evento anterior distingue a las cadenas de Markov de las series de eventos independientes, como tirar una moneda al aire o un dado. FORMULACION DE UNA CADENA DE MARKOV El generador de Markov produce uno de n eventos posibles, Ej , donde j = 1, 2, . . . , n, a intervalos discretos de tiempo (que no tiene que ser iguales ). Las probabilidades de ocurrencia para cada uno de estos eventos dependen del estado del generador. Este estado se describe por el ltimo evento generado. La probabilidad de que Ek sea el siguiente evento generado es una probabilidad

condicional : P ( Ek / Mj ). Esto se llama probabilidad de transicin del estado Mj al estado Ek. Para describir completamente una cadena de Markov es necesario saber el estado actual y todas las probabilidades de transicin.

Estado Generador Evento Formulador de Markov

E1 E2 E3 E4. Ek ---------------------------t1 t2 t3 t4. tk Tiempo http://www.mitecnologico.com/Main/FormulacionCadenasDeMarkov 4.3 PROCESOS ESTOCASTICOS Un proceso estocstico se define sencillamente como una coleccin indexada de variables aleatorias { X1 }, donde el subndice t toma valores de un conjunto T dado. Con frecuencia T se toma como el conjunto de enteros no negativos y X, representa una caracterstica de inters medible en el tiempo t. Por ejemplo, el proceso estocstico, X1 , X2 , X3, .., Puede representar la coleccin de niveles de inventario semanales (o mensuales) de un producto dado, o puede representar la coleccin de demandas semanales (o mensuales) de este producto. Un estudio del comportamiento de un sistema de operacin durante algn periodo suele llevar al anlisis de un proceso estocstico con la siguiente estructura. En puntos especficos del tiempo t , el sistema se encuentra exactamente en una de un nmero finito de estados mutuamente excluyentes y exhaustivos, etiquetados 0, 1, . . , S. Los periodos en el tiempo pueden encontrarse a intervalos iguales o su esparcimiento puede depender del comportamiento general del sistema en el que se encuentra sumergido el proceso estocstico. Aunque los estados pueden constituir una caracterizacin tanto cualitativa como cuantitativa del sistema, no hay prdida de generalidad con las etiquetas numricas 0, 1, . . , M , que se usarn en adelante para denotar los estados posibles del sistema. As la representacin matemtica del sistema fsico es la de un proceso estocstico {Xi}, en donde las variables aleatorias se observan en t = 0, 1, 2,. . ., y en donde cada variable aleatoria puede tomar el valor de cualquiera de los M + 1 enteros 0, 1, .. , M.

Estos enteros son una caracterizacin de los M + 1 estados del proceso. http://www.mitecnologico.com/Main/ProcesosEstocasticos 4.4 PROPIEDAD MARKOVIANA DE PRIMER ORDEN Un proceso markoviano de orden 1 es un proceso estocstico de orden1 en el cual su pasado no tiene ninguna influencia en el futuro si su presente est especificado. Cuando una probabilidad condicional depende nicamente del suceso inmediatamente anterior, cumple con el Principio de Markov de Primer Orden, es decir:

Definiciones en los procesos de Markov de primer orden: Estados: Las condiciones en las cuales se encuentra un ente sucesos posibles. Ensayos: Las ocurrencias repetidas de un evento que se estudia. Probabilidad de Transicin: La probabilidad de pasar de un estado actual a l s i g u i e n t e e n u n p e r o d o t i e m p o , y s e d e n o t a p o r Pij (la probabilidad de pasar del estado i al estado j en una transicin perodo). Caractersticas de los procesos de Markov de primer orden: Se pueden usar como modelo de un proceso fsico econmico que tenga las siguientes propiedades: a) Que la probabilidad cumpla con el principio de Markov. b) Existencia de un nmero finito de estados.

c) Las pij son constante con respecto al tiempo perodo. d) Ensayos en perodos iguales. Si un suceso depende de otro adems del inmediatamente anterior, este es un proceso de Markov de mayor orden. Por ejemplo, un proceso de segundo orden describe un proceso en el cual el suceso depende de los dos sucesos anteriores.

4.5 PROBABILIDAD DE TRANSICIN ESTACIONARIAS DE UN SOLO PASO Una tienda de cmaras tiene en almacn un modelo especial de cmara que se puede ordenar cada semana. Sean d1, d2, . . . l a s d e m a n d a s d e e s t a cmara durante la primera, segunda,..., semana, respectivamente. Se supone que las Di son variables aleatorias independientes e idnticamente distribuidas que tienen una distribucin de probabilidad conocida. Sea X 0 e l n m e r o d e cmaras que se tiene en el momento de iniciar el proceso, X 1 el nmero de cmaras que se tienen al final de la semana uno, X 2 el nmero de cmaras al final de la semana dos, etc. Suponga que X0= 3 . E l s b a d o en la noche la tienda hace un pedido que le entregan el lunes en e l m o m e n t o d e a b r i r l a tienda. La tienda hace un pedido que le entregan el lunes en el momento de abrir la tienda. La tienda usa la siguiente poltica (s, S) ^1 para ordenar: si el nmero de cmaras en inventario al final de la semana es menor que s =1 (no hay cmaras en la tienda), ordenar (hasta) S=3. De otra manera, no coloca la o r d e n ( s i s e cuenta con una o ms cmaras en el almacn, no se hace el pedido). Se supone que las ventas se pierden cuando la demanda excede el inventario. Entonces, {X1} para t = 0, 1,.. Es un proceso estocstico de la forma que se acaba de describir. Los estados posibles del proceso son los enteros 0,1, 2, 3 que representan el nmero posible de cmaras en inventario al final dela semana. Observe que {Xi}, en donde Xi es el nmero de cmaras en el almacn al final de la semana t ( antes de recibir el pedido}), es una cadena de Markov. Se ver ahora cmo obtener las probabilidades de transicin (de un paso), es decir, los elementos de la matriz de transicin (de un paso).

4.6 PROBABILIDAD DE TRANSICIN ESTACIONARIAS DE N PASOS

4.7 PROBABILIDAD DE TRANSICIN ESTACIONARIAS DE ESTADOS ESTABLES 4.8 ESTADOS ABSORVENTES 4.9 USO DE PROGRAMAS DE COMPUTACIN

Anda mungkin juga menyukai

- PRÁCTICA DIRIGIDA N°02-Var.Dokumen2 halamanPRÁCTICA DIRIGIDA N°02-Var.danielBelum ada peringkat

- Física I Curso Intersemestral TallerDokumen3 halamanFísica I Curso Intersemestral TallerJohn Alexander FernandezBelum ada peringkat

- Ecuaciones Cuadrática e IrracionalesDokumen31 halamanEcuaciones Cuadrática e IrracionalesJhordy Toledo UgarteBelum ada peringkat

- 7103-Inferencia VarianzasDokumen12 halaman7103-Inferencia Varianzasvolver11Belum ada peringkat

- Sil Logico MatemáticaDokumen6 halamanSil Logico MatemáticaLeunamBelum ada peringkat

- Calculo Longitud de CadenaDokumen1 halamanCalculo Longitud de CadenaJosé Antonio ContrerasBelum ada peringkat

- Tabla de Valores de Ángulos Especiales - CompletaDokumen1 halamanTabla de Valores de Ángulos Especiales - CompletaCristopher Alexander Alegría RomeroBelum ada peringkat

- Quiz 1 - Semana 3 - CB - SEGUNDO BLOQUE-ESTADISTICA II - (GRUPO5)Dokumen5 halamanQuiz 1 - Semana 3 - CB - SEGUNDO BLOQUE-ESTADISTICA II - (GRUPO5)vanegutyBelum ada peringkat

- Pauta PEP 1 Forma ADokumen6 halamanPauta PEP 1 Forma Aleorio88Belum ada peringkat

- Unidad 2 Solidos-1Dokumen18 halamanUnidad 2 Solidos-1Daiana RamirezBelum ada peringkat

- Método de Beta de NewmarkDokumen18 halamanMétodo de Beta de NewmarkAbelBelum ada peringkat

- EcuacionesDokumen16 halamanEcuacionesCamila CastañónBelum ada peringkat

- PolinomiosDokumen9 halamanPolinomiosMartina OppligerBelum ada peringkat

- Collazos SC PDFDokumen201 halamanCollazos SC PDFJose Luis Reyes GuevaraBelum ada peringkat

- Método de Decisión Multicriterio - Utilidad MultiatributoDokumen5 halamanMétodo de Decisión Multicriterio - Utilidad MultiatributoJohn Fredy Cantor SaldañaBelum ada peringkat

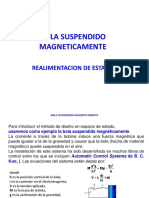

- Bola Suspendido MagneticamenteDokumen10 halamanBola Suspendido MagneticamenteMilo VanvanBelum ada peringkat

- Presentación Matriz de Decisión (Condición de Riesgo)Dokumen22 halamanPresentación Matriz de Decisión (Condición de Riesgo)María Fernanda RojasBelum ada peringkat

- Prueba m4Dokumen10 halamanPrueba m4Fernanda Henriquez GajardoBelum ada peringkat

- Silabo Programación I 2016 IIDokumen9 halamanSilabo Programación I 2016 IIRUBEN GALEAS ARANABelum ada peringkat

- Curso-Computos-MEtricos J & M Ingenieros PDFDokumen37 halamanCurso-Computos-MEtricos J & M Ingenieros PDFÆon Teseract100% (1)

- 4ta Sesion de Ejercicios - Electro - 2021-IIDokumen10 halaman4ta Sesion de Ejercicios - Electro - 2021-IIWitney Yurany QUEMBA PACANCHIQUEBelum ada peringkat

- Razonamiento Matemático 1 Minuto/ejercicioDokumen16 halamanRazonamiento Matemático 1 Minuto/ejerciciojotahcqBelum ada peringkat

- Expresiones BoolenasDokumen11 halamanExpresiones BoolenasDANNY HERMINIA VELASQUEZ OROZCOBelum ada peringkat

- Saul Kripke Necesidad de La Identidad y PDFDokumen19 halamanSaul Kripke Necesidad de La Identidad y PDFMarcosBelum ada peringkat

- Valor Del Dinero en El TiempoDokumen27 halamanValor Del Dinero en El TiempomanuelBelum ada peringkat

- Ejercicios para ClaseDokumen4 halamanEjercicios para ClaseLuis Egberto Alvarado PintadoBelum ada peringkat

- Poligonal Cerrada...Dokumen12 halamanPoligonal Cerrada...Marco JaramilloBelum ada peringkat

- Trabajo de Fase MateDokumen7 halamanTrabajo de Fase MatePaul Escalante CallomamamiBelum ada peringkat

- Isc - Analisis y Diseño de Algoritmos - 2014-1Dokumen2 halamanIsc - Analisis y Diseño de Algoritmos - 2014-1Juan JoseBelum ada peringkat

- Teorema Del Trabajo ReciprocoDokumen4 halamanTeorema Del Trabajo ReciprocoPatrick Flores AranibarBelum ada peringkat