K Means Clustering

Diunggah oleh

JOKO ELIYANTOJudul Asli

Hak Cipta

Format Tersedia

Bagikan dokumen Ini

Apakah menurut Anda dokumen ini bermanfaat?

Apakah konten ini tidak pantas?

Laporkan Dokumen IniHak Cipta:

Format Tersedia

K Means Clustering

Diunggah oleh

JOKO ELIYANTOHak Cipta:

Format Tersedia

10/22/21, 10:09 AM K_Means_Clustering - Jupyter Notebook

Pembuka

Assalamu'alaikum warahmatullahi wabarakatuh. Puji syukur kehadirat Allah Subhana Wata'ala atas limpahan

Rahmat dan HidayahNya kepada kita semua. Sholawat serta salam senantiasa tercurah limpahkan kepada

baginda Muhammad Rasulullah Salallahualaihiwassalam.

Halo para Pejuang Data. Selamat berjumpa di pertemuan kesembilan Program Training Algoritma Machine

Learning Kelas Mahir.

Pada pertemuan ini kamu akan belajar:

K Means Clustering

Algoritma K Means Clustering

Contoh K Means Clustering

Fungsi K Means Clustering

K Means Clustering dengan Scikit Learn

K Means Clustering

K-means (MacQueen, 1967) adalah salah satu algoritma pembelajaran tanpa pengawasan paling sederhana

yang memecahkan masalah pengelompokan yang terkenal. Prosedurnya mengikuti cara sederhana dan

mudah untuk mengklasifikasikan kumpulan data yang diberikan melalui sejumlah cluster tertentu (asumsikan k

cluster) tetap secara apriori. Ide utamanya adalah mendefinisikan k centroid, satu untuk setiap cluster. Centroid

ini harus ditempatkan dengan cara yang licik karena lokasi yang berbeda menyebabkan hasil yang berbeda.

Jadi, pilihan yang lebih baik adalah menempatkan mereka sejauh mungkin dari satu sama lain. Langkah

selanjutnya adalah mengambil setiap titik milik kumpulan data yang diberikan dan mengaitkannya ke centroid

terdekat. Ketika tidak ada poin yang tertunda, langkah pertama selesai dan pengelompokan awal dilakukan.

Pada titik ini kita perlu menghitung ulang k centroid baru sebagai barycenter dari cluster yang dihasilkan dari

langkah sebelumnya. Setelah kita memiliki k centroid baru ini, pengikatan baru harus dilakukan antara titik set

data yang sama dan centroid baru terdekat. Sebuah loop telah dibuat. Sebagai hasil dari loop ini kita dapat

melihat bahwa k centroid mengubah lokasinya langkah demi langkah sampai tidak ada lagi perubahan yang

dilakukan. Dengan kata lain centroid tidak bergerak lagi. Terakhir, algoritma ini bertujuan untuk meminimalkan

fungsi tujuan, dalam hal ini fungsi kesalahan kuadrat. Fungsi tujuan

𝑘 𝑛

𝐽 = ∑ ∑ ‖ 𝑥𝑖(𝑗) − 𝑐𝑗 ‖2

𝑗=1 𝑖=1

di mana ‖ 𝑥(𝑗)𝑖 − 𝑐𝑗 ‖2 adalah ukuran jarak yang dipilih antara titik data 𝑥(𝑗)𝑖 dan pusat cluster 𝑐𝑗 , merupakan

indikator jarak n titik data dari masing-masing pusat cluster.

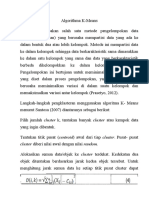

Algoritma K-Means Clustering

1. Tentukan parameter k

2. Tentukan pusat cluster awal secara acak

3. Hitung jarak setiap data ke pusat cluster

4. Tetapkan cluster data berdasarkan pusat cluster terdekat

5. Memperbarui pusat cluster dengan menghitung nilai rata-rata setiap cluster

localhost:8888/notebooks/Pejuang Data 3.0/Training Algoritma Machine Learning/Minggu 5/Pertemuan 1/K_Means_Clustering.ipynb 1/11

10/22/21, 10:09 AM K_Means_Clustering - Jupyter Notebook

6. Ulangi langkah 3-5 sampai kriteria berhenti terpenuhi:

A. Jumlah iterasi tertentu tercapai, ATAU

B. Tidak ada (atau minimal) perbedaan anggota cluster pada dua iterasi terakhir, OR

C. Tidak ada (atau minimum) perbedaan pusat cluster, ATAU

D. Selisih SSE (Sum of Squared Error) minimum

Contoh Implementasi K Means

0. Dataset

𝑥1 𝑥2

1 1

2 3

7 8

8 8

In [1]:

import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

In [2]:

data=pd.DataFrame({"x1":[1,2,7,8], "x2":[1,3,8,8]})

data

Out[2]:

x1 x2

0 1 1

1 2 3

2 7 8

3 8 8

localhost:8888/notebooks/Pejuang Data 3.0/Training Algoritma Machine Learning/Minggu 5/Pertemuan 1/K_Means_Clustering.ipynb 2/11

10/22/21, 10:09 AM K_Means_Clustering - Jupyter Notebook

In [3]:

plt.scatter(data.x1, data.x2)

Out[3]:

<matplotlib.collections.PathCollection at 0x2cce5022460>

1. Tentukan parameternya 𝑘

𝑘=2

In [4]:

k=2

2. Tentukan pusat cluster awal secara acak

Centroid 𝑥1 𝑥2

𝑐1 1 1

𝑐2 2 3

In [5]:

pusat_klaster = np.array([[1,1],[2,3]])

pusat_klaster

Out[5]:

array([[1, 1],

[2, 3]])

localhost:8888/notebooks/Pejuang Data 3.0/Training Algoritma Machine Learning/Minggu 5/Pertemuan 1/K_Means_Clustering.ipynb 3/11

10/22/21, 10:09 AM K_Means_Clustering - Jupyter Notebook

In [6]:

# Determine the initial cluster center randomly

import random

def pusat_klaster_awal(k, data):

X=np.array(data)

n=len(X)

list_1=np.arange(0,n)

pusat_klaster_index = random.choices(list_1, k=k)

pusat_klaster=X[pusat_klaster_index]

return pusat_klaster

3. Hitung jarak setiap data ke pusat cluster

In [7]:

# Define the euclidean distance function

def jarak_euclidean(x,y):

return np.sqrt(sum(pow(a-b, 2) for a, b in zip(x,y)))

In [8]:

def jarak_centroid_euclidean(data,pusat_klaster):

n=len(data)

k=np.array(pusat_klaster).shape[0]

jarak=[]

for i in range(n):

x = list(data.iloc[i,::])

jrk = [jarak_euclidean(x, pusat_klaster[j]) for j in range(k)]

jarak.append(jrk)

return jarak

In [9]:

jarak_centroid=jarak_centroid_euclidean(data,pusat_klaster)

jarak_centroid

Out[9]:

[[0.0, 2.23606797749979],

[2.23606797749979, 0.0],

[9.219544457292887, 7.0710678118654755],

[9.899494936611665, 7.810249675906654]]

4. Tetapkan klaster data berdasarkan pusat klaster terdekat

localhost:8888/notebooks/Pejuang Data 3.0/Training Algoritma Machine Learning/Minggu 5/Pertemuan 1/K_Means_Clustering.ipynb 4/11

10/22/21, 10:09 AM K_Means_Clustering - Jupyter Notebook

In [10]:

def menentukan_klaster(jarak_centroid):

n=len(jarak_centroid)

label_klaster=list()

for i in range(n):

max_val, idx = min((val, idx) for (idx, val) in enumerate(jarak_centroid[i]))

label_klaster.append(idx)

return label_klaster

In [11]:

klaster=menentukan_klaster(jarak_centroid)

klaster

Out[11]:

[0, 1, 1, 1]

5. Memperbarui pusat cluster dengan menghitung nilai rata-rata setiap cluster

In [12]:

def menghitung_pusat_klaster(data, klaster):

data['label']=klaster

pusat_barudf=data.groupby('label', as_index=False).mean()

pusat_barudf=pusat_barudf.iloc[::,1:]

pusat_klaster_baru=np.array(pusat_barudf)

return pusat_klaster_baru

In [13]:

pusat_klaster_baru=menghitung_pusat_klaster(data, klaster)

pusat_klaster_baru

Out[13]:

array([[1. , 1. ],

[5.66666667, 6.33333333]])

6. Ulangi langkah 2 - 5 hingga kriteria henti dipenuhi:

In [14]:

def perubahan_pusat_klaster_euclidean(pusat_klaster_lama, pusat_klaster_baru):

perubahan = 0

for a,b in zip(pusat_klaster_lama, pusat_klaster_baru):

perubahan+=jarak_euclidean(a,b)

return perubahan

localhost:8888/notebooks/Pejuang Data 3.0/Training Algoritma Machine Learning/Minggu 5/Pertemuan 1/K_Means_Clustering.ipynb 5/11

10/22/21, 10:09 AM K_Means_Clustering - Jupyter Notebook

In [15]:

perubahan_pusat_klaster_euclidean(pusat_klaster, pusat_klaster_baru)

Out[15]:

4.955356249106169

Fungsi K Means Clustering

In [16]:

def plot_klaster(X, klaster, pusat_klaster):

df = pd.DataFrame(dict(x=X[:,0], y=X[:,1], label=klaster))

colors = {0:'blue', 1:'orange', 2:'green'}

fig, ax = plt.subplots(figsize=(8, 8))

grouped = df.groupby('label')

for key, group in grouped:

group.plot(ax=ax, kind='scatter', x='x', y='y', label=key, color=colors[key])

ax.scatter(pusat_klaster[:, 0], pusat_klaster[:, 1], marker='*', s=150, c='#ff2222')

plt.xlabel('X_1')

plt.ylabel('X_2')

plt.show()

In [17]:

def k_means(k, df):

X=np.array(df)

pusat_klaster_lama = pusat_klaster_awal(k, X)

klaster = [0]*len(X)

epsilon = 100

iterasi = -1

while epsilon>.001:

jarak_ke_pusat_klaster=jarak_centroid_euclidean(df,pusat_klaster_lama)

klaster = menentukan_klaster(jarak_ke_pusat_klaster)

plot_klaster(X, klaster, pusat_klaster_lama)

pusat_klaster_baru = menghitung_pusat_klaster(df, klaster)

epsilon = perubahan_pusat_klaster_euclidean(pusat_klaster_lama, pusat_klaster_baru)

pusat_klaster_lama = pusat_klaster_baru

iterasi += 1

return iterasi, klaster, pusat_klaster_baru

localhost:8888/notebooks/Pejuang Data 3.0/Training Algoritma Machine Learning/Minggu 5/Pertemuan 1/K_Means_Clustering.ipynb 6/11

10/22/21, 10:09 AM K_Means_Clustering - Jupyter Notebook

In [18]:

iterasi, klaster, pusat_klaster= k_means(2, data)

In [19]:

pusat_klaster

Out[19]:

array([[7.5, 8. ],

[1.5, 2. ]])

K-Means Clustering menggunakan Python Scikit Learn

In [20]:

from sklearn.cluster import KMeans

import numpy as np

data=pd.DataFrame({"x1":[1,2,7,8], "x2":[1,3,8,8]})

X=np.array(data)

X

Out[20]:

array([[1, 1],

[2, 3],

[7, 8],

[8, 8]], dtype=int64)

In [21]:

kmeans = KMeans(n_clusters=2, random_state=0).fit(X)

localhost:8888/notebooks/Pejuang Data 3.0/Training Algoritma Machine Learning/Minggu 5/Pertemuan 1/K_Means_Clustering.ipynb 7/11

10/22/21, 10:09 AM K_Means_Clustering - Jupyter Notebook

In [22]:

kmeans.labels_

Out[22]:

array([0, 0, 1, 1])

In [23]:

kmeans.predict([[0, 0], [12, 3]])

Out[23]:

array([0, 1])

In [24]:

kmeans.cluster_centers_

Out[24]:

array([[1.5, 2. ],

[7.5, 8. ]])

Latihan

Diberikan Dataset

In [25]:

data=pd.DataFrame({"Province Name":["Jakarta", "Jawa Tengah", "Bali", "Sumatera Selatan", "

"Confirmed":[1231, 1452, 789, 201, 78, 45],

"Death":[10, 35, 8, 2, 1, 0]})

data_used=data[["Confirmed", "Death"]]

data_used

Out[25]:

Confirmed Death

0 1231 10

1 1452 35

2 789 8

3 201 2

4 78 1

5 45 0

localhost:8888/notebooks/Pejuang Data 3.0/Training Algoritma Machine Learning/Minggu 5/Pertemuan 1/K_Means_Clustering.ipynb 8/11

10/22/21, 10:09 AM K_Means_Clustering - Jupyter Notebook

In [26]:

# Cluster the dataset above using K Means clustering into 2 cluster.

iterasi, klaster, pusat_klaster= k_means(2, data_used)

localhost:8888/notebooks/Pejuang Data 3.0/Training Algoritma Machine Learning/Minggu 5/Pertemuan 1/K_Means_Clustering.ipynb 9/11

10/22/21, 10:09 AM K_Means_Clustering - Jupyter Notebook

localhost:8888/notebooks/Pejuang Data 3.0/Training Algoritma Machine Learning/Minggu 5/Pertemuan 1/K_Means_Clustering.ipynb 10/11

10/22/21, 10:09 AM K_Means_Clustering - Jupyter Notebook

localhost:8888/notebooks/Pejuang Data 3.0/Training Algoritma Machine Learning/Minggu 5/Pertemuan 1/K_Means_Clustering.ipynb 11/11

Anda mungkin juga menyukai

- Mari Belajar Pemrograman Berorientasi Objek menggunakan Visual C# 6.0Dari EverandMari Belajar Pemrograman Berorientasi Objek menggunakan Visual C# 6.0Penilaian: 4 dari 5 bintang4/5 (16)

- K-Means Clustering (Case 2 Cluster)Dokumen6 halamanK-Means Clustering (Case 2 Cluster)Jans HendryBelum ada peringkat

- Algorithma K MeansDokumen10 halamanAlgorithma K MeansyunbetrysiagianBelum ada peringkat

- K-Means Clustering To Design Radial Basis Function Neural Network (RBFNN) ClassifiersDokumen9 halamanK-Means Clustering To Design Radial Basis Function Neural Network (RBFNN) ClassifiersHAYQAL HAZMI QASTARIBelum ada peringkat

- Panduan Penggunaan Gui SurveykepuasanDokumen9 halamanPanduan Penggunaan Gui SurveykepuasanAbdul ArifBelum ada peringkat

- K Means AlgorithmDokumen5 halamanK Means AlgorithmParamita MayadewiBelum ada peringkat

- Clustering K MeansDokumen11 halamanClustering K MeansSofyan Thayf0% (1)

- I Made Gde Putra Dipanala - Tugas Clustering PythonDokumen7 halamanI Made Gde Putra Dipanala - Tugas Clustering PythonHanita PradnyaBelum ada peringkat

- K Means ClusteringDokumen28 halamanK Means ClusteringIrene SitumorangBelum ada peringkat

- Bab 6Dokumen4 halamanBab 6Hani Amany ElisadiBelum ada peringkat

- Algoritma K MeansDokumen16 halamanAlgoritma K MeansGandhix BhamakertiBelum ada peringkat

- Spesifikasi Tugas Besar - AIDokumen4 halamanSpesifikasi Tugas Besar - AITaufik Agung SantosoBelum ada peringkat

- Pert5 Overview ClusteringDokumen30 halamanPert5 Overview ClusteringNisa AlyaBelum ada peringkat

- 2.3. Algoritma-WPS OfficeDokumen3 halaman2.3. Algoritma-WPS OfficeChandra HandikaBelum ada peringkat

- Modul 9Dokumen7 halamanModul 9Victor Imannuel KartikaBelum ada peringkat

- Modul 11. Klasifikasi Dengan FuzzyDokumen9 halamanModul 11. Klasifikasi Dengan FuzzyHadziq Mufid Mahmud IVBelum ada peringkat

- Pert Ke 9 Sistem CerdasDokumen16 halamanPert Ke 9 Sistem CerdasErwin ArryBelum ada peringkat

- Bab 6Dokumen5 halamanBab 6Rebecca OctavianiBelum ada peringkat

- 09 KmeansDokumen18 halaman09 KmeansAnametri Learning CenterBelum ada peringkat

- FDokumen14 halamanFRizal ZulmiBelum ada peringkat

- 1 PBDokumen6 halaman1 PBseptianfirman firmanBelum ada peringkat

- Data Mining - KMeansDokumen20 halamanData Mining - KMeansDiansesa RahmatikaBelum ada peringkat

- Learning Progress Review Week 4Dokumen55 halamanLearning Progress Review Week 4Rama DhaniBelum ada peringkat

- Chapter0 NumpyDokumen47 halamanChapter0 NumpyAdhyaksa Meiputra HermawanBelum ada peringkat

- 6.1 Metode Kernel PDFDokumen12 halaman6.1 Metode Kernel PDFErniwati Halawa0% (1)

- Data Mining FCM PrintDokumen31 halamanData Mining FCM PrintCassandra ShawBelum ada peringkat

- Modul ML Prakt - 6 K-Means ClusteringDokumen10 halamanModul ML Prakt - 6 K-Means Clusteringrifqy nurkholiqBelum ada peringkat

- M. Fikri Zulhimmah S - 28323001 M2Dokumen5 halamanM. Fikri Zulhimmah S - 28323001 M2frizulhBelum ada peringkat

- IsiDokumen31 halamanIsiangga tambaBelum ada peringkat

- Di PythonDokumen3 halamanDi Pythonmuhammad ikhwanul afifBelum ada peringkat

- Klasterisasi Proses Seleksi Pemain Menggunakan Algoritma K-MeansDokumen5 halamanKlasterisasi Proses Seleksi Pemain Menggunakan Algoritma K-MeansSujacka RetnoBelum ada peringkat

- HawiNatalino K-MeansalgorithDokumen8 halamanHawiNatalino K-MeansalgorithHawiNatalinoBelum ada peringkat

- Materi 10 - K-Means Clustering 2022Dokumen33 halamanMateri 10 - K-Means Clustering 2022Marvelio LarkBelum ada peringkat

- Modul DatminDokumen53 halamanModul DatminAnggita CinantiasariBelum ada peringkat

- Assalamualaikum TemenDokumen2 halamanAssalamualaikum TemenDana HarliansyahBelum ada peringkat

- CLUSTERINGDokumen6 halamanCLUSTERINGRagelliya HalimBelum ada peringkat

- Maulva Nazir Ahmad - 10120627 - 4KA13 - LAPORAN M-8Dokumen7 halamanMaulva Nazir Ahmad - 10120627 - 4KA13 - LAPORAN M-8mazinzan rusmantoBelum ada peringkat

- Laporan Clustering 42520011Dokumen8 halamanLaporan Clustering 42520011sasa123Belum ada peringkat

- Bab 2Dokumen14 halamanBab 2BayuARBelum ada peringkat

- Laporan 8 16211223086Dokumen29 halamanLaporan 8 16211223086rifqy nurkholiqBelum ada peringkat

- Tugas Deep Learning P-13 Leni e 201810225080Dokumen7 halamanTugas Deep Learning P-13 Leni e 201810225080Lenny ApriliaBelum ada peringkat

- ID Implementasi Jaringan Syaraf Tiruan UntuDokumen15 halamanID Implementasi Jaringan Syaraf Tiruan UntuMutiara PurnamaBelum ada peringkat

- Lapres 8.2 ProgkomDokumen12 halamanLapres 8.2 ProgkomIndah Nur Laila100% (1)

- Fik 10104657Dokumen34 halamanFik 10104657SigitPangestuTuNdanBelum ada peringkat

- Modul Praktikum I - Analisis Data Statistika - Statistika Deskriptif - RDokumen11 halamanModul Praktikum I - Analisis Data Statistika - Statistika Deskriptif - RHuber YudaBelum ada peringkat

- TestDokumen4 halamanTestIqbal FaturrahmanBelum ada peringkat

- 6b. Fuzzy C Means PDFDokumen15 halaman6b. Fuzzy C Means PDFJullend GatcBelum ada peringkat

- Metode K-MeansDokumen5 halamanMetode K-MeansFajar SinaringtyasBelum ada peringkat

- Fuzzy ClusteringDokumen6 halamanFuzzy ClusteringPandu Taruna BuanaBelum ada peringkat

- Pemrograman Jaringan Kohenen Dengan MatlabDokumen33 halamanPemrograman Jaringan Kohenen Dengan MatlabMega HijrianiBelum ada peringkat

- Analisis Cluster Berbasis PartisiDokumen26 halamanAnalisis Cluster Berbasis Partisiyuwarnadewi67% (3)

- Tugas 8 ResumeDokumen23 halamanTugas 8 ResumedewirizkifBelum ada peringkat

- Muhammad Ammar Farhan PutraDokumen10 halamanMuhammad Ammar Farhan PutrasalmahayyuBelum ada peringkat

- Tugas Fuzzy C-MeansDokumen10 halamanTugas Fuzzy C-Meanstigris nainggolanBelum ada peringkat

- Katon Prasetio - 11 - TE2C - Modul 1Dokumen20 halamanKaton Prasetio - 11 - TE2C - Modul 1Katon PrasetioBelum ada peringkat

- Analisa Cluster LanjutanDokumen57 halamanAnalisa Cluster LanjutanRifky NovrianBelum ada peringkat

- Analisis Iris DataDokumen15 halamanAnalisis Iris DataPaulina Ade Cahyanti100% (1)

- Tugas Besar Pembelajaran Mesin 1 - ClusteringDokumen12 halamanTugas Besar Pembelajaran Mesin 1 - ClusteringKaenova Mahendra Auditama100% (1)

- 04 Kaunia Vol - VIII No.2 Sri Utami Zuliana Penerapan Global Ridge Regression Pada Peramalan Data Time Series Non LinearDokumen11 halaman04 Kaunia Vol - VIII No.2 Sri Utami Zuliana Penerapan Global Ridge Regression Pada Peramalan Data Time Series Non LinearIfrina NurithaBelum ada peringkat

- Data Mining Kelompok KmeansDokumen15 halamanData Mining Kelompok KmeansVici HooBelum ada peringkat